Im Vergleich: Snowflake und Databricks

Snowflake ist bereit für den Unternehmenseinsatz, Databricks nicht.

99,99 %

Verfügbarkeitsgarantie (SLA)

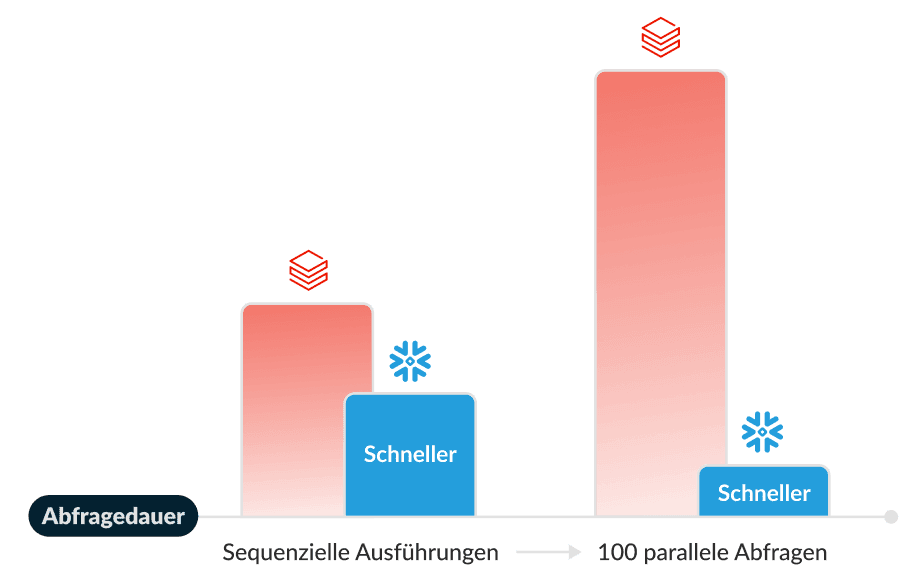

2x

schnellere Performance bei zentralen Analytics-Workloads auf Snowflake

Kein Lock-in

Snowflake ist offen und interoperabel

Über 12.000 Unternehmen weltweit nutzen die Snowflake AI Data Cloud für ihre KI, ihre Apps und ihre Daten:

Der Vergleich auf

einen Blick

Während Daten und KI neue Herausforderungen in den Bereichen Sicherheit, Governance und Resilienz mit sich bringen, legen Kunden größeren Wert auf Vertrauen, Flexibilität und Skalierbarkeit.

Snowflake wurde von Grund auf für Großunternehmen entwickelt. Databricks fehlen wichtige Funktionen in Bereichen wie Geschäftskontinuität/Notfallwiederherstellung, Sicherheit, Governance, offenen Standards, Kostenmanagement und Performanceoptimierung.*

|

Snowflake |

Databricks |

|

|---|---|---|

|

Geschäftskritische Funktionen |

Faster performance at enterprise scale |

Keine einfache Out-of-the-box-Disaster-Recovery, komplexe Cross-Cloud-Architektur; Lücken im Unity Catalog |

|

Offene Plattform |

True open source commitment |

Nicht an den entscheidenden Stellen offen |

|

Kosten und Performance |

Faster performance at enterprise scale |

Langsamer und höhere Kosten |

* Stand: 5. November 2025

Snowflake bietet integrierte Governance und Zuverlässigkeit mit einer SLA-Garantie von 99,99 %.

Gesundheitswesen und Life Sciences

Sanofi beschleunigt Analyse realer Klinikdaten mit Snowpark

Indem Sanofi seine verwaltete Spark-Lösung durch Snowflake ersetzte, konnte das Unternehmen seine Datenverarbeitung beschleunigen und die Gesamtbetriebskosten verringern – und das alles mit optimaler Compliance und Data Governance.

- 50 % bessere Performance gegenüber der vorherigen, verwalteten Spark-Lösung

- 100 Mio. Datensätze von Patient:innen pro Kohorte, die durchschnittlich in vier Minuten verarbeitet werden

Snowflake bietet eine vollständig offene, interoperable Plattform.

„Viele Teams bei Indeed waren bestrebt, Daten so schnell wie möglich in Snowflake zu integrieren ... Die native Unterstützung von Snowflake für Iceberg Tables bietet die Performance, Sicherheit und die skalierbaren Rechenressourcen, die erforderlich sind, um dies zu ermöglichen.“

Daniel DeMara

Staff Software Engineer, Indeed

Customer Story lesen (Englisch)

- 43–74 % Kostensenkung im Vergleich zu vorherigen Analysetools

Snowflake ist doppelt so schnell, und das zur Hälfte der Kosten.

Basierend auf Kunden-POCs und Tests von Drittanbietern; die tatsächliche Performance kann variieren.

EDF entwickelt intelligente Customer Engine mit der Snowflake AI Data Cloud

EDF hat seine intelligente Customer Engine auf Snowflake entwickelt und so die Bereitstellungszeit des Modells von Monaten auf Wochen reduziert. So konnte das Unternehmen viermal schneller neue Datenprodukte entwickeln und Einblicke zur Verbesserung der Energieeffizienz liefern.

- 4-mal mehr Datenprodukte pro Jahr prognostiziert

- 2 Monate für den Aufbau der neuen intelligenten Customer Engine

Warum führende Unternehmen Snowflake nutzen

50 % Latenzverbesserung

Penske konnte durch den Wechsel von Databricks zu Snowflake und Snowpark DataFrames die Performance verbessern, die Latenz verringern und so die betriebliche Effizienz steigern.

Kosteneinsparungen in Millionenhöhe

Guitar Center erzielte durch Kosteneinsparungen einen ROI in Millionenhöhe, da sich Nutzende heute auf Analysen statt auf den manuellen Datenabruf konzentrieren können.

70 % Kosteneinsparungen

Moser Consulting konnte durch den Wechsel von Databricks zu Snowflake 70 % an Kosten einsparen, indem redundante Services beseitigt wurden und die Nutzung von Cloudressourcen reduziert wurde.

75 % Kosteneinsparungen

IGS Energy konnte seine Kosten um 75 % reduzieren, indem das Training von Prognosemodellen in Databricks auf ein einheitliches Modell in Snowflake umgestellt wurde.

Die Snowflake AI Data Cloud

Häufig gestellte Fragen

Snowflake bietet ein Verfügbarkeits-SLA von 99,99 % und damit eine hohe Zuverlässigkeit für seine Kunden.

Snowflake umfasst BCDR als verwaltete Standardfunktion, die Replikation und einen nahtlosen Failover über Regionen und Clouds hinweg bietet. Databricks erfordert für die BCDR-Implementierung einen erheblichen „Do-it-yourself“-Aufwand, der Monate in Anspruch nehmen kann, und bietet trotz allem keine umfassende Notfallbereitschaft.

Unity Catalog ist kein vollständig unternehmenstauglicher Katalog, da bestimmte grundlegende Kontrollen fehlen oder nicht ausreichen:

Sofort einsatzbereite, einfache Geschäftskontinuität/Notfallwiederherstellung ist hier nicht zu finden.*

Die präzisen Zugriffskontrollen von Unity Catalog weisen Lücken auf.

Es fehlen fortschrittliche Datenschutzfunktionen wie Differential Privacy sowie Aggregation und Projection Policies, während diese Funktionen in Snowflake Horizon Catalog schon seit Jahren Standard sind.

Unity Catalog bietet ein übermäßig komplexes cloudübergreifendes Management, darunter komplexes Data Sharing und Management über Clouds und Regionen hinweg. Diese Funktionen sind bei Snowflake Horizon Catalog grundlegend und bieten eine deutlich höhere Nutzerfreundlichkeit.

Ausschlaggebend ist jedoch, dass Databricks Unity Catalog nicht Open Source ist und keinen offiziell dokumentierten Migrationspfad zu Unity Catalog OSS bietet. Und auch Unity OSS verfügt nicht über leistungsstarke Governance- oder Sicherheitsfunktionen (siehe Roadmap).

Darüber hinaus bietet Databricks keine proaktive Cyberabwehr, Bedrohungsprävention und -wiederherstellung – im Gegensatz zu Snowflake, das native Bedrohungsprävention (Schutz vor schädlichen IPs), unveränderliche Backups für optimale Compliance und vieles mehr bietet.

Snowflake Data Sharing bietet sicheres cloud- und regionsübergreifendes Data Sharing mit rollenbasierter Zugriffskontrolle und Richtlinien. Es ist kosteneffizient dank Funktionen wie dem Egress Cost Optimizer und dem Data-Sharing-Rabattprogramm. Snowflake unterstützt die gemeinsame Nutzung von KI-Modellen und allen Arten KI-fähiger Daten, einschließlich Daten in offenen Tabellenformaten wie Apache Iceberg und Delta Lake, sowie von KI-Assets. All das ist sowohl für Snowflake-Kunden als auch für andere Unternehmen sofort verfügbar.

Databricks Delta Sharing kann kostentechnisch untragbar sein. Je mehr Datennutzer Delta Sharing in entlegenen Regionen verwenden, desto höher fallen die CSP-Egress-Kosten für Datenanbieter aus. Delta Sharing Open Source weist verschiedene Einschränkungen in Bezug auf Datensicherheit und Governance auf und Kunden müssen den unternehmenseigenen Unity Catalog nutzen, um das Data Sharing sinnvoll nutzen zu können. Schließlich können Databricks-Kunden derzeit weder Agenten noch Unity Catalog Metric Views oder Suchservices teilen. Hierdurch fällt für diese Kunden eine hohe technische Komplexität bei der Bereitstellung von Daten für Agenten und KI an.

Snowflakes Open-Data-Philosophie lautet: „Ihre Architektur sollte Ihnen gehören, nicht Ihrem Anbieter.“ Das zeigen auch unsere laufenden Beiträge zu OSS-Projekten wie Apache Iceberg™, Apache Polaris™, Apache Nifi™ und zuletzt Open Semantic Interchange (OSI), das anbieterneutrale Governance und Entwicklung fördert. Das gibt Kunden die Freiheit, die besten Tools auszuwählen, ohne Angst vor einer Anbieterbindung zu haben.

Databricks hingegen beginnt mit einem Open-Source-Versprechen, während wichtige Enterprise-Funktionen auch weiterhin unternehmenseigen bleiben. So fehlen beispielsweise zentrale Sicherheitsfunktionen in der Open-Source-Version von Unity Catalog (Unity OSS). Das bedeutet, dass Kunden den unternehmenseigenen Databricks Unity Catalog für Sicherheits- und Governance-Funktionen verwenden müssen und dass ihre Architektur von der Roadmap und den Prioritäten von Databricks abhängig ist.

Snowflake bietet einen vollständig verwalteten und serverlosen Service, der Kunden durch integrierte Optimierungen wie automatisches Clustering und Query Acceleration Service dabei unterstützt, schnellere Ergebnisse zu erzielen. Snowflake kontrolliert und optimiert die Kosten auf transparente Weise mit einem sofort einsatzbereiten Cost Management Interface, das eine Konto- und Unternehmensübersicht für Ausgaben, Budgets und Kosteneinblicke enthält, mit denen Kunden ihre Ausgaben optimieren können.

Kunden-POCs und Drittanbietertests zeigen, dass bei Databricks die Kosten steigen und die Performance sinkt, wenn Daten komplexer werden oder wenn Parallelität und Datenvolumen zunehmen. Databricks hinkt auch bei der nativen Kosten-Governance hinterher: Es können keine Ausgabenlimits durchgesetzt werden und die Kostenattribution auf Abfrageebene ist begrenzt.