Dal pilot a 6000 utenti: come scalare gli agenti AI in azienda

A metà 2025 abbiamo lanciato lo Snowflake GTM AI Assistant per circa 6000 utenti nel nostro team sales e marketing, il primo deployment enterprise su larga scala di Snowflake Intelligence. Entro fine anno, l’assistente aveva già risposto a oltre 330.000 domande, aiutando le persone a lavorare più velocemente e a prendere decisioni migliori.

Negli ultimi mesi abbiamo pubblicato diversi post, rivolti agli sviluppatori, sulle basi tecniche per creare un assistente AI enterprise: come strutturare i dati di vendita, abilitare il knowledge retrieval per i contenuti non strutturati, testare il comportamento dell’agente e perfezionare le istruzioni. Post utili, certo, ma le domande che continuavamo a ricevere non erano solo tecniche:

Come avete composto il team?

Che aspetto aveva la timeline di sviluppo?

Come avete fatto il rollout senza incrinare la fiducia?

Quali tattiche di change management hanno funzionato davvero?

Che risultati avete visto dopo il lancio?

Questo articolo si concentra proprio su questi elementi non tecnici: struttura del team, fasi di lancio, strategia di perimetro e come siamo passati da un MVP a una capability enterprise affidabile.

Team di sviluppo e fasi di lancio

Abbiamo iniziato a fine febbraio 2025 con un obiettivo mirato: creare un assistente di knowledge basato su RAG, così i team GTM potessero trovare i documenti giusti tra strumenti frammentati, pagine web e drive. All’epoca, il progetto aveva un solo data scientist dedicato.

A fine maggio 2025, abbiamo deciso di puntare su un vero GTM AI assistant con Snowflake Intelligence, non solo indicizzando i contenuti di conoscenza, ma anche integrando dati strutturati di sales e marketing. Quel cambio di direzione ha alzato l’asticella su qualità e affidabilità, quindi abbiamo portato il team a tre o quattro data scientist e aggiunto un product manager dedicato.

Dal Day 1 abbiamo trattato qualità e fiducia degli utenti come P(-1). Le interviste agli utenti e l’esperienza su progetti AI precedenti ci hanno chiarito una cosa: La prima impressione determina l’adozione. Se le prime esperienze non sono affidabili, ricostruire la fiducia richiede uno sforzo enormemente maggiore rispetto a fare le cose bene fin dall’inizio.

Ecco perché abbiamo scelto una strategia di rollout per fasi: Partire in piccolo, validare qualità e workflow, poi espandere.

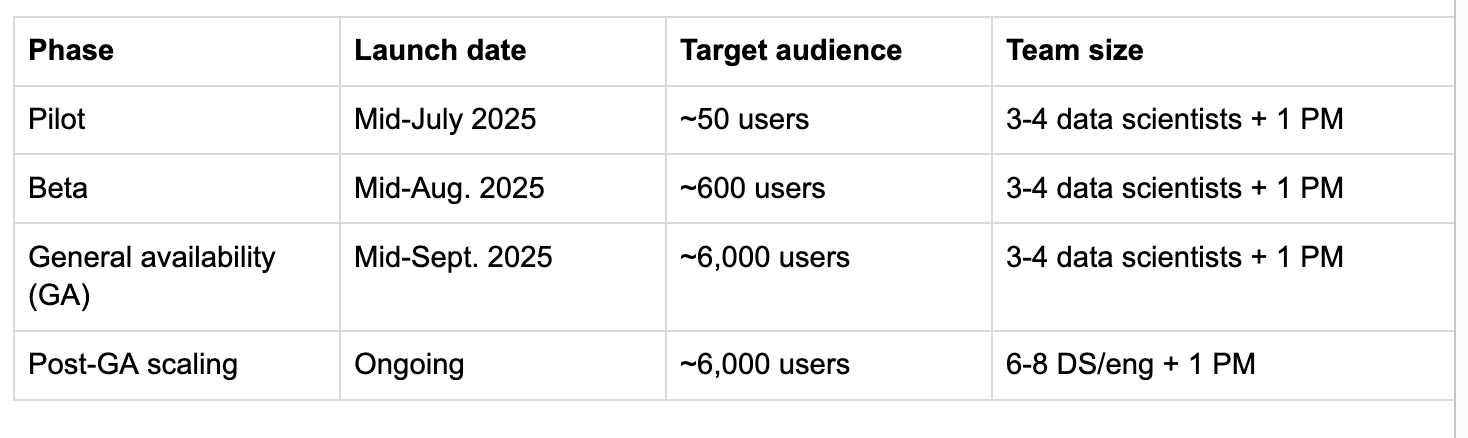

Ecco, in sintesi, come si presentavano le nostre fasi di lancio:

Suggerimento: Un errore ricorrente che vediamo spesso è spingere un agente verso un utilizzo esteso prima che rispetti con costanza gli standard di qualità. Prototipare agenti AI è facile, portare agenti affidabili a migliaia di utenti è la parte difficile. Dai ai team tempo e spazio per conquistare la fiducia all’inizio: ripaga più avanti.

Da un MVP mirato a capability in espansione

Gli ambienti enterprise sono complessi. Solo nel nostro team sales e marketing supportiamo oltre 15 personas distinte, ognuna con workflow ed esigenze diverse:

Account executive (AE)

Solution engineer (SE)

SDR

Product marketing manager

Partner/alliance manager

Specialisti dei servizi professionali

Leadership sales e marketing

Campaign manager

… e altro ancora

Come per qualsiasi prodotto, abbiamo evitato la trappola del “connetti tutto e spera che gli utenti capiscano”. Abbiamo invece iniziato deliberatamente con un MVP più mirato, concentrato sulle personas per cui potevamo generare più valore, più rapidamente.

In base alla dimensione dell’audience e allo sforzo di sviluppo per persona, abbiamo concentrato il lancio in GA su AE, SE e SDR. Questi tre gruppi rappresentavano circa il 50% della nostra audience target di 6000 utenti, permettendoci di massimizzare l’impatto iniziale mantenendo il perimetro gestibile.

Dopo la GA, abbiamo ampliato in modo intenzionale, sbloccando nuovi profili e nuove capability un passo alla volta, senza compromettere l’affidabilità per l’audience core.

Ecco un esempio indicativo di come le capability dell’agente si sono ampliate nel tempo:

Perimetro GA: Knowledge Assistant + dati core di Salesforce, utilizzo prodotto e finanza.

Primo mese post-GA: Bug fix e copertura più ampia e approfondita delle stesse fonti.

Wave successive: Nuove fonti dati, ad esempio dati marketing, trascrizioni di call ed email, dati di partnership, supporto alla ricerca sul web e altro ancora.

Quando abbiamo lanciato l’AI assistant a metà settembre 2025, era alimentato da sei semantic view con 48 tabelle e circa 1400 colonne. Dopo la GA, abbiamo rilasciato oltre 40 nuove funzionalità/fonti dati, espandendo il layer dati a 10 semantic view con 64 tabelle e oltre 1750 colonne.

Suggerimento: Un perimetro troppo ampio è una delle cause più comuni per cui le iniziative AI in azienda si bloccano. Inizia con un perimetro in cui l’agente risponde a meno domande, ma le risponde correttamente. È più facile espandere le capability dopo aver costruito fiducia che recuperare l’adozione dopo fallimenti iniziali.

Attivazione utenti e change management

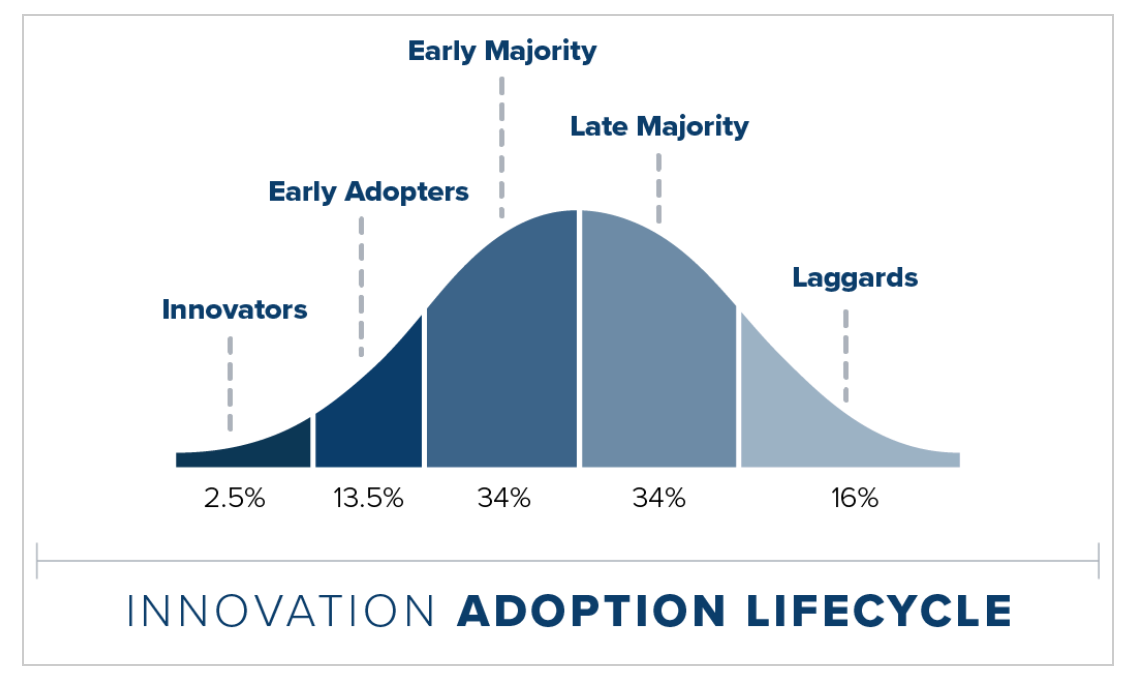

Implementare con successo soluzioni enterprise richiede tempo, spesso un trimestre intero o più. Come in qualsiasi rollout di prodotto, gli utenti seguono naturalmente la curva di adozione: innovatori, early adopter, maggioranza iniziale e tardiva, e ritardatari.

La teoria della diffusione delle innovazioni di Everett Rogers.

Durante pilot e beta, l’engagement tende ad arrivare dagli utenti più in alto su questa curva, quelli desiderosi di sperimentare nuovi strumenti. Quando arrivi alla GA e scali a migliaia di utenti, la realtà cambia. Entrano in gioco i late adopter, le aspettative aumentano e può emergere frustrazione se l’adozione non accelera abbastanza.

È qui che molte iniziative AI, anche solide, si bloccano, non perché la tecnologia non funzioni, ma perché gli utenti non la adottano davvero.

Fare in modo che gli utenti lo provino davvero

Integrare un AI assistant nel lavoro quotidiano significa cambiare abitudini in modo importante. La maggior parte delle persone non cambierà a meno che la tua soluzione non sia nettamente migliore, 10 volte più veloce, 10 volte più semplice, oppure abiliti qualcosa che prima era impossibile. La parità funzionale con gli strumenti esistenti raramente basta, soprattutto per i late adopter.

Detto questo, anche il miglior prodotto non conquista utenti se non lo provano nemmeno.

Quindi, come fai a far sì che le persone provino il tuo AI assistant e tornino a usarlo?

Prima valida la qualità e ottimizza per la “stickiness”

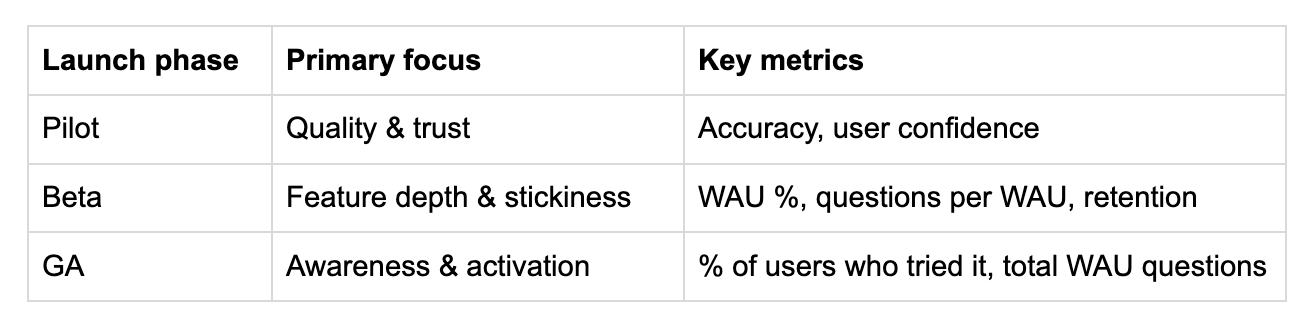

Il nostro approccio è stato deliberato e sequenziale, in linea con le fasi di lancio:

Durante il pilot ci siamo concentrati esclusivamente su qualità e fiducia. Il nostro obiettivo principale era validare correttezza, affidabilità e utilità di base, ricorda: la qualità è P(-1).

In beta, una volta dimostrata la qualità, abbiamo spostato il focus su completezza funzionale e stickiness. La domanda è diventata: Questo agente risolve abbastanza problemi reali da spingere le persone a tornare, settimana dopo settimana?

I risultati ci hanno dato fiducia:

92% di NPS tra gli utenti beta

70% di retention WAU (weekly active user)

Queste metriche ci hanno confermato che avevamo un prodotto che valeva la pena scalare.

Creare slancio ed entusiasmo in azienda

In fase GA, la nostra domanda principale è diventata molto semplice: Gli utenti sanno dell’esistenza del GTM AI Assistant e lo stanno davvero provando?

Per favorire l’adozione, abbiamo collaborato a stretto contatto con il team di sales enablement e ci siamo assicurati che le basi fossero solide:

Una pagina prodotto interna dedicata

Guide utente chiare e documentazione how-to

Video brevi con top user che condividono best practice

Un canale Slack dedicato per feedback e richieste di funzionalità

Da lì, abbiamo costruito slancio in modo attivo:

Email di lancio e demo live con i singoli team

Menzioni regolari da parte dei sales executive, e persino del nostro CEO, durante all-hands e riunioni di team

Report settimanali sull’adozione condivisi con la leadership sales, così potessero incoraggiare la partecipazione nei loro team

Questa combinazione di enablement, visibilità e supporto della leadership è stata decisiva.

Il risultato: Adozione sostenuta su larga scala

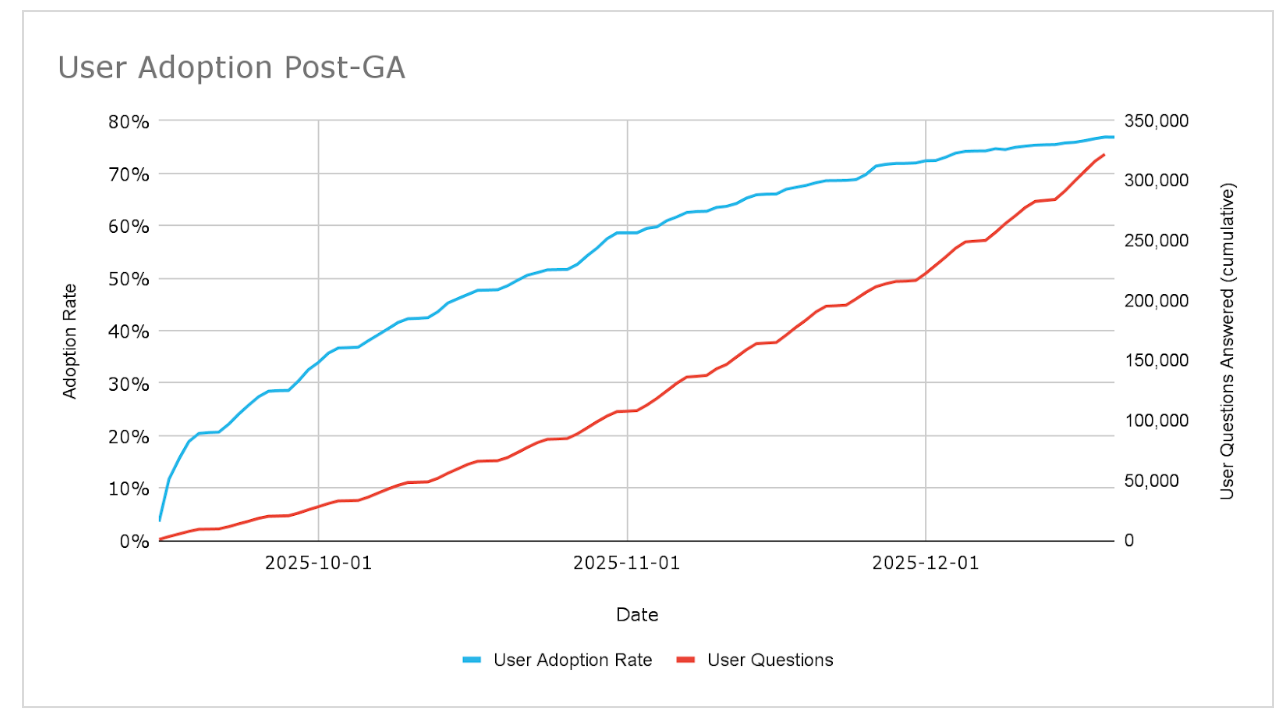

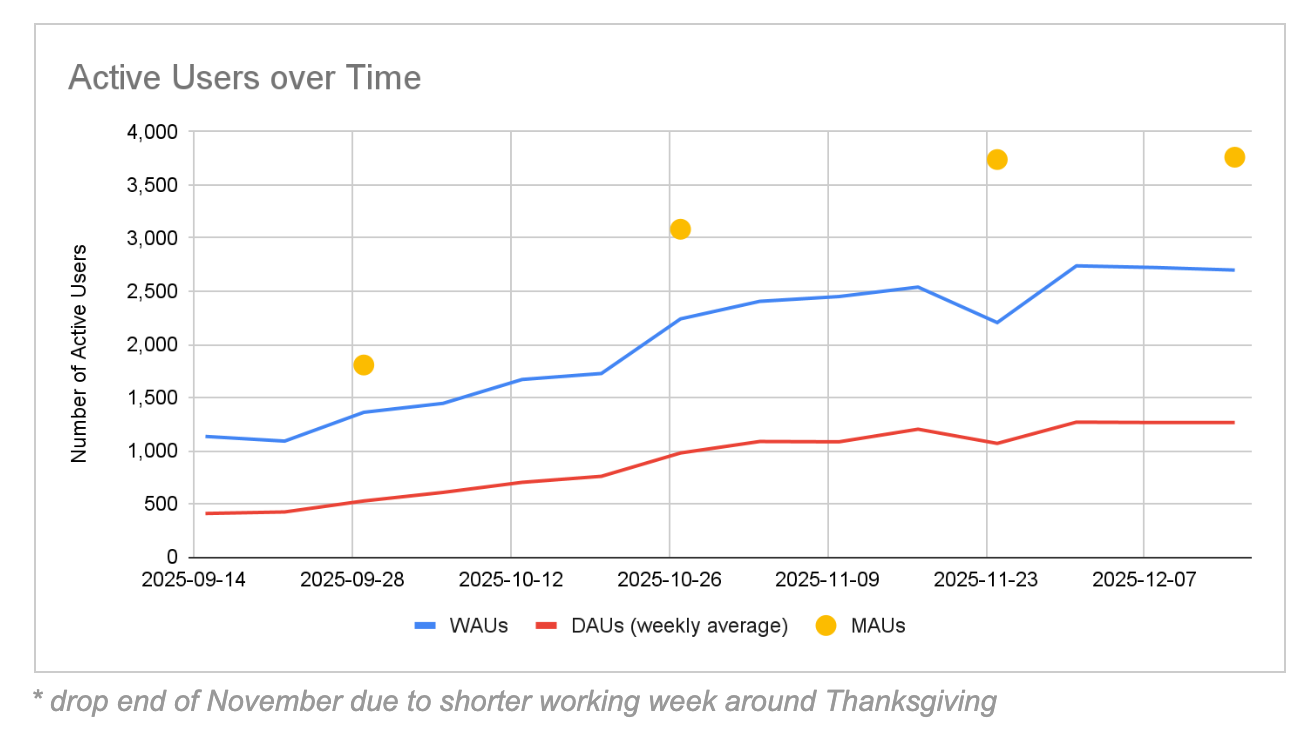

Grazie a un’azione disciplinata di activation e change management, abbiamo ottenuto un’adozione significativa del GTM AI assistant nei 3 mesi successivi alla GA.

Tutto questo impegno ha dato i suoi frutti. Nelle prime due settimane dopo la GA, circa il 25% degli utenti abilitati aveva provato l’agente almeno una volta. Entro fine anno, quel dato è salito a quasi il 77% complessivo e a oltre il 90% per le nostre personas principali (AE, SE e SDR).

Per noi, questo ha rafforzato una lezione chiave: Scalare l’AI in azienda non è solo una sfida tecnica: è anche un problema di attivazione del prodotto e di change management.

Product thinking dopo il lancio

Il cambiamento è bidirezionale.

Trasformare i workflow go-to-market con agenti AI enterprise è un cambio importante, non solo per gli utenti ma anche per i team dati che costruiscono questi agenti.

Tradizionalmente, i team dati sono abituati a lavorare su progetti relativamente circoscritti: creare pipeline dati, addestrare modelli o lanciare dashboard, spesso con un’evoluzione limitata dopo il go-live. Una volta rilasciati, questi asset richiedono in genere solo manutenzione incrementale.

Gli agenti AI sono radicalmente diversi.

Un AI assistant enterprise è un prodotto vivo. Interagisce continuamente con gli utenti, si adatta a nuovi dati, evolve con workflow che cambiano e deve tenere il passo con l’innovazione rapida di piattaforme e modelli. Questo richiede un passaggio verso product thinking, progettazione a livello di sistema e collaborazione continua nel tempo.

Come abbiamo adattato il team dopo la GA

Dopo un lancio GA di successo, abbiamo dovuto evolvere il nostro modo di lavorare.

Quasi subito abbiamo visto:

Un’impennata di richieste di nuove funzionalità da parte degli utenti

Aspettative più alte su reattività e affidabilità

Un bisogno crescente di bilanciare iterazione rapida e mantenimento della fiducia

Cambiamenti continui nella piattaforma AI sottostante, che hanno richiesto di rivedere decisioni progettuali prese in precedenza

Allo stesso tempo, la qualità non poteva calare. I bug andavano risolti rapidamente, le regressioni evitate e i miglioramenti rilasciati senza destabilizzare l’esperienza di cui gli utenti si fidavano.

Scalare il prodotto ha significato scalare anche il nostro modello operativo.

In cosa abbiamo investito dopo il lancio

Per non farci travolgere, e per mantenere lo slancio, abbiamo investito fin da subito in queste aree:

Un modo di lavorare agile: Siamo passati a uno sviluppo per sprint, con un framework chiaro di intake, triage e prioritizzazione per bilanciare bug, richieste di funzionalità e miglioramenti di lungo periodo.

Espansione del team con competenze complementari: Oltre alla data science, abbiamo aggiunto capacità di analytics engineering e backend engineering, allineate alle esigenze di roadmap e alla complessità del sistema.

Test automatizzati e CI/CD: Poco dopo la GA, abbiamo investito in framework di test automatizzati e pipeline CI/CD per aumentare la velocità di deployment mantenendo standard di qualità elevati.

Tempo dedicato alla salute e all’evoluzione della piattaforma: Ogni sprint includeva capacità esplicita per refactoring, evoluzione dell’architettura e upgrade di piattaforma, così da prevenire debito tecnico nel lungo periodo.

Il punto chiave

Lanciare un agente AI enterprise non è il traguardo: è il punto di partenza.

Il successo di lungo periodo richiede di trattare gli agenti AI come prodotti, non come progetti: con ownership, iterazione, rigore operativo e investimenti continui. I team che abbracciano questo cambiamento sono molto più preparati a scalare in modo responsabile, adattarsi al cambiamento e continuare a generare valore mentre evolvono aspettative degli utenti e capability dell’AI.

Impatto e ROI

A questo punto potresti chiederti: Quali sono stati i risultati concreti, e ne è valsa la pena?

Vediamolo nel dettaglio.

Entro fine 2025, il GTM AI Assistant rispondeva a oltre 35.000 domande a settimana per più di 2500 utenti attivi settimanali, rispetto a circa 10.000 domande settimanali al lancio iniziale.

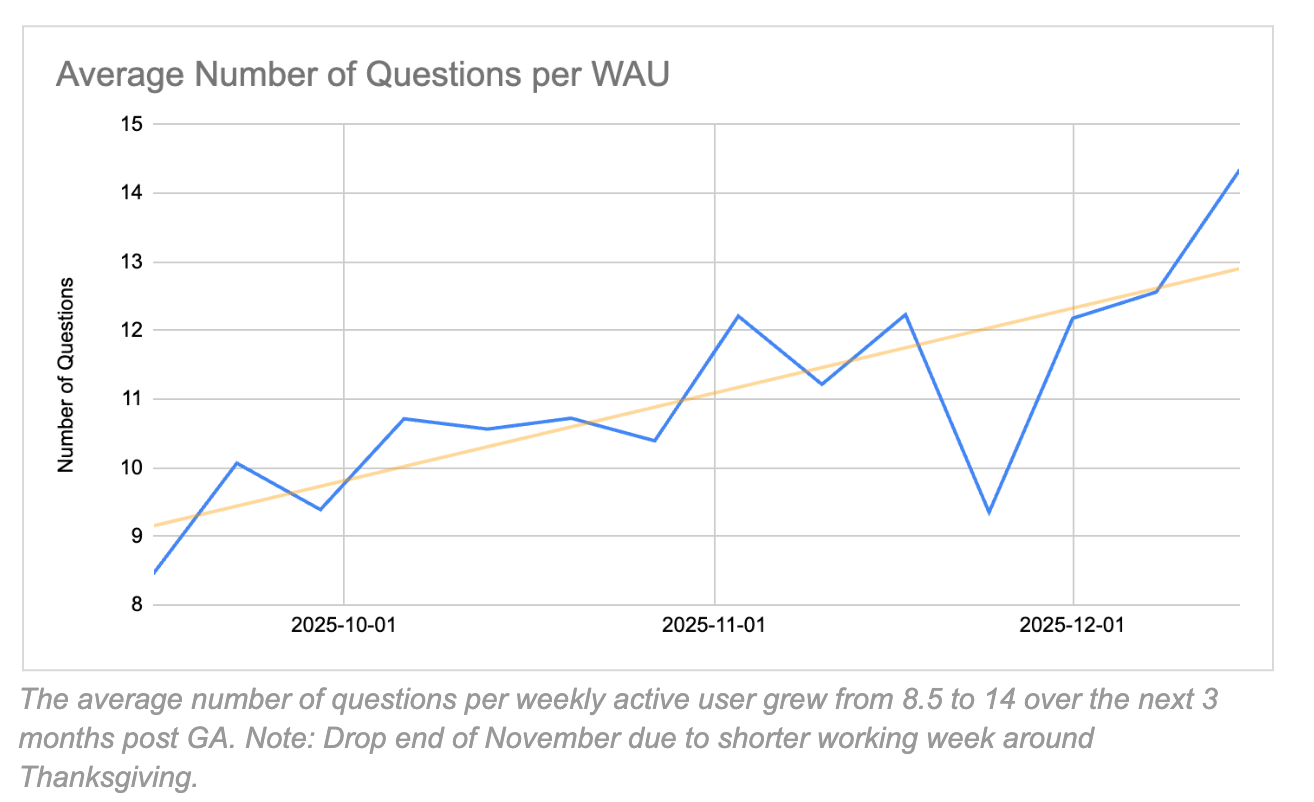

Questa crescita non è dipesa solo dall’adozione.

Nei tre mesi successivi alla GA, man mano che ampliavamo le capability dell’assistente e gli utenti lo integravano nei workflow quotidiani, l’intensità d’uso è aumentata in modo significativo. Il numero medio di domande per utente attivo settimanale è passato da 8,5 a 14, a conferma di una fiducia più alta e di un’integrazione più profonda nel lavoro reale.

Guadagni di produttività su scala enterprise

Il risparmio di tempo variava in base al caso d’uso:

Minuti per recupero semplice di conoscenza o dati

Ore per analisi più complesse che altrimenti avrebbero richiesto SQL personalizzato o supporto di un analista

Anche con un’ipotesi conservativa di 5 minuti risparmiati per domanda, l’impatto cresce rapidamente. Alla nostra scala, questo si è tradotto nell’equivalente di oltre 65 FTE di produttività annuale in un’organizzazione di 6000 persone.

E si tratta di una stima al ribasso.

Dimostrare il ROI su larga scala

A fine 2025 abbiamo svolto un’analisi dettagliata per comprendere struttura dei costi e ritorno sull’investimento del GTM AI Assistant.

L’analisi ha mostrato che il costo per utente attivo era paragonabile a quello dei classici strumenti enterprise di produttività su base per utente. Confrontato con i guadagni di produttività generati, l’assistente ha prodotto un ritorno sull’investimento superiore a 5 volte, ancora prima di eventuali iniziative dedicate di ottimizzazione dei costi.

È importante sottolineare che questa stima include solo risparmi diretti di produttività. Esclude benefici secondari come riduzione del carico sugli analisti, cicli di vendita più rapidi e migliore qualità decisionale per i team sales e marketing. In altre parole, l’equazione economica era convincente ben prima che la soluzione raggiungesse piena maturità o efficienza operativa.

Considerazioni finali

L’AI sta trasformando in modo radicale le aziende e i team go-to-market.

L’era di demo isolate e sperimentazioni su piccola scala sta finendo. Oggi l’AI enterprise sta generando un impatto reale e misurabile su larga scala. Ma per ottenere questo impatto serve più di modelli solidi o prompt ben scritti: servono il mindset giusto, esecuzione disciplinata e un’attenzione profonda al change management.

Come abbiamo spiegato in questo articolo, per scalare con successo gli agenti AI in azienda è fondamentale:

Trattare qualità e fiducia come non negoziabili

Lanciare con intenzione ed espandere il perimetro in modo deliberato

Investire in activation e adozione, non solo in tecnologia

Evolvere i team dati verso una ownership di prodotto di lungo periodo

Le aziende che faranno bene tutto questo nei prossimi mesi non si limiteranno a migliorare la produttività: cambieranno profondamente il modo in cui i team lavorano e otterranno un vantaggio competitivo significativo.

Il cambiamento è già in corso. Le aziende che agiscono ora definiranno la prossima generazione dell’esecuzione go-to-market.