Governance AI-ready per i dati sul personale

I dati sul personale (anche detti dati workforce o dati dei dipendenti), comprendono informazioni dettagliate sulle persone lungo tutto il loro ciclo di vita lavorativo. Rappresentano tra gli asset più sensibili e regolamentati in un’organizzazione e, man mano che le aziende applicano l’AI all’analisi della workforce e all’esperienza dei dipendenti, la sfida di governare questi dati diventa significativamente più complessa.

Per supportare un’AI responsabile senza rallentare l’innovazione, le organizzazioni devono adottare un approccio AI-ready alla gestione e alla governance dei dati della workforce. Integrando i controlli di governance direttamente nella piattaforma dati enterprise, le organizzazioni possono garantire controlli coerenti e applicabili su AI generativa, analytics e machine learning, creando le basi per distribuire strumenti AI su scala più ampia, preservando al contempo la fiducia dei dipendenti.

Perché i dati della workforce rappresentano la sfida più complessa per la governance AI

I dati della workforce si differenziano in modo sostanziale da altri domini di dati aziendali. Sono dati protetti e sensibili dal punto di vista etico, utilizzati per decisioni ad alto impatto sulle persone, soggetti a normative sovrapposte e strettamente legati alla fiducia dei dipendenti.

L’AI amplifica queste criticità. A differenza dell’analisi tradizionale, i sistemi AI non si limitano a riportare informazioni sui dati della workforce. Apprendono da essi, ne traggono inferenze e agiscono di conseguenza. Una volta che i dati della workforce entrano nelle pipeline AI, la loro influenza si estende oltre i singoli record, contribuendo a modellare modelli e previsioni che possono persistere ben oltre l’accesso ai dati originari.

I moderni sistemi AI vengono utilizzati per prevedere il tasso di abbandono, valutare candidati, analizzare performance e potenziale e generare riepiloghi o raccomandazioni tramite AI generativa. In questi sistemi, un errore di governance incide su persone reali, non solo su metriche. Bias, utilizzi impropri o inferenze non intenzionali possono influenzare decisioni di assunzione, percorsi di carriera ed esperienza dei dipendenti in modi difficili da individuare o correggere. Di conseguenza, i dati della workforce rappresentano una delle sfide più impegnative e rilevanti per la governance dell’AI.

Categorie di rischio AI specifiche per i dati della workforce

Rischio legato ai dati di training

Il rischio legato ai dati di training emerge quando dati workforce sensibili o protetti vengono incorporati nell’addestramento dei modelli AI in modi che ne influenzano il comportamento oltre l’uso previsto. Poiché i modelli apprendono pattern dai dati storici, eventuali bias o squilibri presenti nei dati di training possono diventare parte integrante del modello stesso.

I set di dati di training possono includere attributi demografici, storico retributivo, feedback sulle performance o indicatori relativi a salute e congedi. Se attributi protetti entrano nelle pipeline di training, direttamente o tramite variabili correlate, i modelli possono rafforzare bias storici e generare esiti discriminatori. Una volta distribuiti, questi problemi sono difficili da rilevare e spesso richiedono riaddestramento o dismissione del modello per essere corretti, rendendo la governance dei dati di training un elemento fondamentale dell’AI responsabile focalizzata sulle persone.

Rischio in fase di inferenza

Il rischio in fase di inferenza si verifica quando i sistemi AI accedono o deducono informazioni workforce sensibili durante previsioni o interazioni in tempo reale. Poiché l’inferenza è continua e guidata da prompt dinamici, aumenta il rischio di esposizione involontaria dei dati.

Nelle soluzioni AI focalizzate sulle persone, l’inferenza può includere contesto relativo ai dipendenti nei prompt di AI generativa, inferenze indirette di attributi protetti o accesso a una quantità di dati superiore al necessario. Nei sistemi di AI generativa, i modelli possono inoltre far emergere contesti sensibili negli output anche quando tali attributi sono mascherati in fase di accesso. Questi rischi sono particolarmente rilevanti per chatbot HR, assistenti per manager e strumenti self-service per dipendenti, dove il comportamento dell’AI è difficile da prevedere e opera su larga scala.

Rischio operativo e di fiducia

Il rischio operativo e di fiducia si manifesta quando i sistemi AI si basano su dati sul personale che evolvono più rapidamente rispetto ai processi di governance e supervisione. Strutture organizzative, architetture di ruolo e framework di performance cambiano continuamente, richiedendo che modelli e feature restino allineati alle definizioni correnti.

In assenza di solide policy di governance, i sistemi AI possono utilizzare dati obsoleti o non certificati, le definizioni delle feature possono divergere e gli output diventare difficili da spiegare o giustificare. Nel tempo, tali criticità possono compromettere la fiducia di dipendenti, manager e autorità di controllo. Una volta persa la fiducia nei sistemi AI focalizzati sulle persone, è spesso difficile ripristinarla.

Che cosa significa governance AI-ready per i dati sul personale?

La governance AI-ready per i dati sul personale si concentra sul controllo, la contestualizzazione, la tracciabilità e l’audit dell’utilizzo dei dati lungo l’intero ciclo di vita dell’AI, preservando privacy e fiducia organizzativa. Richiede meccanismi di governance progettati all’interno dell’architettura dati e AI e applicati per impostazione predefinita ovunque i dati sul personale vengano utilizzati o consultati.

Invece di essere aggiunta a posteriori alle applicazioni HR o alle pipeline ML, la governance deve essere integrata direttamente nella piattaforma dati enterprise. Questo abilita privacy by design, con controlli e auditability intrinseci, e privacy by default, con comportamenti restrittivi applicati salvo esplicita deroga.

I requisiti fondamentali includono governance dei dati a livello di piattaforma, classificazione guidata dai metadati con coerenza semantica, applicazione programmatica delle policy, controlli di accesso basati sullo scopo e sull’intento e lineage e osservabilità end-to-end.

La piattaforma dati come piano di controllo della governance

La governance AI-ready si basa su una piattaforma dati centralizzata che funge da sistema di controllo per analytics, ML e workload AI. Per implementarla, è necessario un catalogo dati enterprise che consenta di governare, scoprire, condividere e distribuire tutti gli asset dati e AI, inclusi i metadati open source. I controlli di governance devono essere applicati dove i dati vengono archiviati, consultati e trasformati, non tramite strumenti disconnessi o processi a valle.

In questo modello, la piattaforma fornisce accesso unificato ai workload, metadati e classificazione centralizzati, policy dichiarative per mascheramento e filtraggio e condivisione sicura dei dati con controlli di governance ereditati.

La piattaforma deve inoltre applicare i requisiti di residenza dei dati. I dati workforce possono essere soggetti a vincoli giurisdizionali che ne impediscono l’uscita da determinate regioni. Quando la residenza è applicata by design, i dati sul personale restano fisicamente nella regione di riferimento, mentre output governati come aggregati, feature o parametri di modello possono essere condivisi tramite secure data sharing o approcci di federated learning.

Coerenza semantica come componente fondamentale

La governance AI richiede coerenza semantica. Un modello governato dei dati sul personale definisce entità canoniche, dimensioni conformi e fatti evento o snapshot per abilitare tagging, lineage e stewardship coerenti.

La classificazione a livello di colonna etichetta i singoli attributi in base a sensibilità e utilizzo consentito, permettendo l’applicazione dinamica delle policy. I dati personali possono essere mascherati salvo accesso da parte di ruoli HR autorizzati, gli attributi protetti esclusi dal training e le retribuzioni aggregate per l’inferenza, consentendo a un unico set di dati di supportare molteplici casi d’uso governati. L’accesso è ulteriormente regolato tramite role-based access control, allineato all’intento e non solo all’identità.

Lineage per explainability e audit

Il lineage offre visibilità su come i dati sul personale fluiscono e vengono trasformati lungo il ciclo di vita dell’AI, dai sistemi sorgente a feature, modelli e output AI. Consente alle organizzazioni di comprendere in che modo i dati influenzano le decisioni guidate dall’AI.

Un lineage efficace contribuisce anche alla tutela della privacy. Tracciando relazioni e influenze tramite identificatori pseudonimizzati, il lineage supporta audit ed explainability senza esporre dati personali identificabili. I dati identificabili sono accessibili solo tramite controlli separati e basati sullo scopo. Questa separazione tra tracciabilità e identificabilità è essenziale per un’AI etica e per qualsiasi soluzione AI che coinvolga dati sul personale.

Snowflake Horizon e applicazione della governance AI

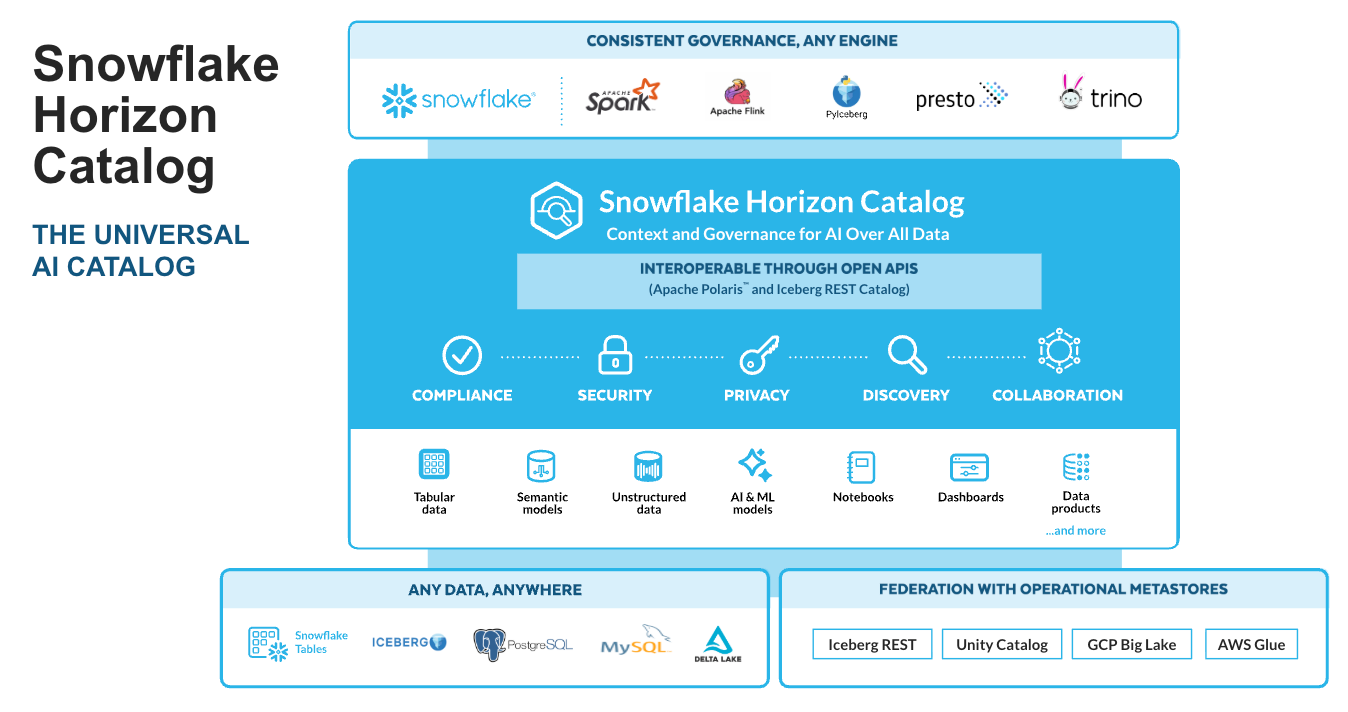

Snowflake Horizon Catalog è il catalogo AI universale con contesto e governance per l’AI su tutti i dati. È compatibile con qualsiasi motore e qualsiasi formato di dati, ovunque, su oggetti nativi Snowflake, dati in formati open table come Apache Iceberg™ e Delta, leggibili e scrivibili da qualsiasi motore, e dati in database relazionali come SQL Server e Postgres. Offre i componenti fondamentali per realizzare una governance AI-ready dei dati sul personale:

- Interoperabilità senza lock-in: Abilita un’architettura lakehouse che integra dati provenienti da sistemi eterogenei, rendendoli interoperabili e portabili tramite standard aperti come Apache Iceberg e Apache Polaris, in incubazione.

- Funzionalità di sicurezza e governance di livello enterprise per dati e AI: Fornisce role-based access control per dati, modelli AI e agenti AI.

- Contesto rilevante: Aiuta l’AI a comprendere e interpretare meglio i tuoi dati.

- Gestione e condivisione cross-region e cross-cloud su scala: Consente gestione coerente, collaborazione fluida e BCDR.

Horizon Catalog offre un livello di governance unificato che rende operativa la governance AI-ready dei dati sul personale su analytics, ML e AI generativa. Combina classificazione guidata dai metadati, applicazione dei controlli di accesso, osservabilità e lineage in un unico framework applicato in modo coerente lungo tutto il ciclo di vita dell’AI. Con livelli in fase di inferenza come Snowflake Cortex Guard, Horizon Catalog trasforma la governance da semplice esercizio di policy a modello operativo applicabile.

Implementare una Governance AI-ready

I dati delle persone si collocano all’intersezione tra privacy, equità e fiducia organizzativa. Man mano che l’AI incide sempre di più sulle decisioni relative alla workforce, eventuali fallimenti di governance hanno un impatto diretto sugli individui, non solo sui risultati di business.

La governance AI-ready dei dati sul personale implica integrare controlli applicabili direttamente nella piattaforma dati, abilitando privacy, explainability e responsabilità by design e by default. Le organizzazioni che adottano questo modello possono scalare in modo responsabile soluzioni AI focalizzate sulle persone, preservando la fiducia, rispettando le aspettative normative e liberando il pieno potenziale delle analytics guidate dall’AI.

Scopri di più su Snowflake Horizon Catalog e su come supporta le tue esigenze di governance, oppure consulta la guida per sviluppatori per approfondire come iniziare con Horizon Catalog per la data governance in Snowflake.