Snowflake vs. Databricks

Snowflake est pensé pour les entreprises. Databricks ne l’est pas.

99,99 %

SLA garanti par Snowflake

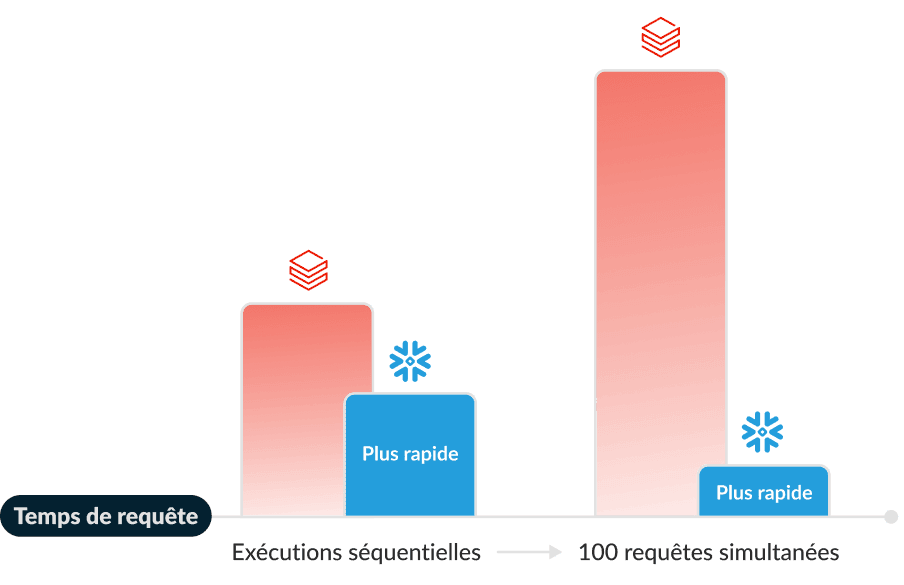

2x

des performances 2 fois plus rapides pour les analyses de base sur Snowflake

Zéro Lock-in

Snowflake est une plateforme ouverte et interopérable

Plus de 12 000 entreprises utilisent l’AI Data Cloud de Snowflake pour alimenter leur IA, leurs applications et leurs données

Snowflake vs. Databricks

en résumé

Alors que les données et l’IA posent de nouveaux défis en matière de sécurité, de gouvernance et de résilience, les clients exigent plus de confiance, de flexibilité et d’évolutivité.

Snowflake est pensé pour les entreprises dès la conception. Databricks ne dispose pas de certaines fonctionnalités essentielles dans des domaines tels que la continuité de l’activité/la reprise après sinistre, la sécurité, la gouvernance, les normes ouvertes, la gestion des coûts et l’optimisation des performances.*

|

Snowflake |

Databricks |

|

|---|---|---|

|

Capacités critiques pour l'entreprise |

Faster performance at enterprise scale |

Pas de solution simple et prête à l'emploi pour la reprise après sinistre ; cloud hybride complexe ; lacunes dans Unity Catalog. |

|

Plateforme ouverte |

True open source commitment |

Pas là où ça compte vraiment |

|

Coût et performance |

Faster performance at enterprise scale |

Plus lent et plus coûteux |

* Au 5 novembre 2025

Snowflake offre une gouvernance et une fiabilité intégrées, avec un engagement de SLA de 99,99 %.

Sanofi bénéficie d’une analyse plus rapide des données cliniques réelles avec Snowpark

En remplaçant sa solution gérée Spark par Snowflake, Sanofi a accéléré son traitement des données et réduit son coût total de possession, tout en garantissant la conformité et la gouvernance de ses données.

- 50% d’amélioration des performances par rapport à la solution Spark gérée précédente

- 100 M de dossiers patients par cohorte, traités en quatre minutes en moyenne

Snowflake dispose d’une plateforme véritablement ouverte et interopérable.

Accor construit une Customer Data Platform pour renforcer l’impact de ses campagnes marketing

Avec Snowflake et Hightouch, Accor, un leader mondial de l’hospitalité, développe une Customer Data Platform pour maximiser la performance de ses campagnes, optimiser ses budgets marketing et offrir des expériences clients ultra-personnalisées.

- 2 mois pour lancer la CDP après les tests initiaux

- 85% plus rapide en extraction de données pour les besoins de segmentation

Snowflake est deux fois plus rapide et deux fois moins cher.

Selon des démonstrations de faisabilité client et des tests tiers. Les performances réelles peuvent varier.

EDF développe son Intelligent Customer Engine sur le Data Cloud Snowflake

EDF a construit son Intelligent Customer Engine sur Snowflake, réduisant ainsi le temps de déploiement des modèles de plusieurs mois à quelques semaines. EDF a ainsi pu développer de nouveaux produits de données 4 fois plus rapidement, fournissant des informations qui améliorent l’efficacité énergétique.

- 4x plus de produits de données prévus chaque année

- 2 mois pour développer le nouveau Intelligent Customer Engine

Pourquoi les entreprises les plus performantes choisissent Snowflake

Plus de 200 utilisateurs: aucun impact sur la performance des requêtes

Bumble dispose désormais d’une plateforme capable de s’adapter à la hausse, sans compromis ni besoin de solutions complexes.

Des millions de dollars économisés

Un retour sur investissement équivalent à des millions de dollars d’économies en donnant aux utilisateurs les moyens de se concentrer sur l’analyse plutôt que sur la récupération manuelle des données.

70 % de réduction des coûts

Coûts réduits de 70 % en éliminant les services redondants et en réduisant l’utilisation des ressources cloud lors du passage de Databricks à Snowflake.

Accélérer la mise à disposition de nouveaux médicaments

Novartis exploite l’AI Data Cloud pour numériser ses opérations et traiter d'énormes volumes de données, afin d'offrir des traitements aux patients plus rapidement et à moindre coût.

L’AI Data Cloud de Snowflake

Questions fréquentes

Snowflake propose un SLA de 99,99 %, offrant ainsi une grande fiabilité à ses clients.

Snowflake inclut la BCDR en tant que fonctionnalité gérée standard qui assure la réplication et le basculement fluide entre les régions et les clouds. Avec Databricks, mettre en œuvre la BCDR nécessite un important travail de « bricolage » qui peut prendre des mois et ne garantit pas de pouvoir totalement faire face à un sinistre.

Unity Catalog n’est pas un catalogue entièrement adapté aux entreprises, car certains contrôles de fondation manquent ou sont incomplets :

La continuité de l’activité/reprise après sinistre simple et prête à l’emploi n’existe pas*.

Les contrôles d’accès détaillés d’Unity Catalog comportent des lacunes.

Les fonctionnalités de confidentialité avancées, notamment les politiques différentielles de confidentialité, d’agrégation et de projection font défaut, bien que de telles fonctionnalités soient standard dans Snowflake Horizon Catalog depuis des années.

Unity Catalog propose une gestion cross-cloud trop complexe. C’est le cas par exemple du partage et de l’administration entre les clouds et les régions. Ces fonctionnalités sont à la base de Snowflake Horizon Catalog.

Point essentiel, Databricks Unity Catalog n’est pas open source et n’offre aucune possibilité de migration officiellement documentée vers Unity Catalog OSS. Unity OSS lui-même ne dispose pas de capacités fiables de gouvernance ou de sécurité (voir la feuille de route).

En plus de ce qui précède, Databricks ne fournit pas de cyberdéfense proactive, de prévention des menaces et de récupération après incident, contrairement à Snowflake, qui offre une prévention native des menaces (protection contre les IP malveillantes), des sauvegardes immuables garantissant la conformité et plus encore.

Snowflake Data Sharing offre un partage sécurisé cross-cloud et entre les régions avec des politiques et un contrôle d’accès basés sur les rôles. Il est économique grâce à des fonctionnalités telles que l’Egress Cost Optimizer et le Data Sharing Rebate Program. Snowflake prend en charge le partage de modèles d’IA et de tous types de données compatibles avec l’IA, y compris les données dans des formats de table ouverts tels qu’Apache Iceberg et Delta Lake, et les ressources d’IA. Le tout est disponible dès sa mise en service pour les clients Snowflake et non-Snowflake.

Databricks Delta Sharing peut s’avérer coûteux. Plus les consommateurs utilisent Delta Share depuis des régions éloignées, plus un fournisseur paie pour les sorties CSP. L’open source avec Delta Sharing présente plusieurs limites en matière de sécurité et de gouvernance des données. Les clients sont tenus d’utiliser le catalogue Unity Catalog propriétaire pour tout partage significatif. Enfin, les clients de Databricks ne peuvent pas partager d’agents, Unity Catalog Metric Views ou de services de recherche. Cela signifie que les clients doivent gérer une complexité significative d’ingénierie lorsqu’ils préparent les données pour les agents et l’IA.

La philosophie open data de Snowflake est que « vous possédez votre architecture, pas votre fournisseur ». Ce principe est appuyé par nos contributions continues aux projets OSS, tels qu’Apache Iceberg™, Apache Polaris™, Apache Nifi™ et, plus récemment, Open Semantic Interchange (OSI), qui favorise une gouvernance et un développement indépendants des fournisseurs. Ainsi, nos clients peuvent choisir librement les meilleurs outils sans craindre d’être contraints par leurs fournisseurs.

À l’inverse, Databricks part d’une promesse open source, mais les capacités stratégiques pour les entreprises restent propriétaires. Par exemple, la version open source d’Unity Catalog (Unity OSS) est dépourvue de fonctionnalités de sécurité de base, ce qui signifie que les clients doivent adopter le Databricks Unity Catalog propriétaire pour les fonctionnalités de sécurité et de gouvernance, et que leur architecture devient dépendante de la feuille de route et des priorités de Databricks.

Entièrement géré et serverless, Snowflake aide ses clients à générer plus rapidement de la valeur grâce à ses optimisations intégrées, notamment le clustering automatique et le Query Acceleration Service. Snowflake contrôle et maîtrise les coûts de manière transparente grâce à son interface de gestion des coûts prête à l’emploi. Celle-ci inclut une vue d’ensemble du compte et de l’organisation pour fournir des informations sur les dépenses, les budgets et les coûts afin d’optimiser les dépenses.

Selon des démonstrations de faisabilité client et des tests tiers, les coûts de Databricks augmentent et ses performances ralentissent lorsque les données, la simultanéité ou les volumes augmentent. Databricks accuse également un retard en matière de gouvernance native des coûts. Il est en effet impossible d’appliquer des limites de dépenses et difficile d’attribuer les coûts au niveau des requêtes.