Daten ohne Limits für Ihre Unternehmens-KI

Seien wir ehrlich: Ohne eine absolut belastbare Datengrundlage können Sie keine großartigen Agentic AI-Produkte entwickeln. Tatsache ist jedoch, dass die meisten Datengrundlagen erhebliche Risse aufweisen. Entwickler:innen und Produktmanager:innen verbringen immer noch zu viel Zeit damit, mit fragmentierten oder unzugänglichen Daten zu ringen und zu versuchen, Daten über isolierte Systeme hinweg zu steuern. Diese Reibungsverluste rücken großartige Ideen weiter von der Umsetzung in die Praxis ab.

Snowflake setzt genau hier an.

Heute stellt Snowflake eine Reihe neuer Tools und Verbesserungen vor, die sich ausschließlich darauf konzentrieren, Entwickler:innen maximale Datenflexibilität und -zugänglichkeit zu bieten. Unsere Fortschritte bei Snowflake Horizon Catalog, Snowflake Openflow und Snowflake Postgres in Kombination mit Performance-Verbesserungen machen es Entwickler:innen leichter, sich sicher mit ihren Unternehmensdaten zu verbinden und sie zu nutzen, indem sie:

Optimierung von Datenmigrationen mit Hilfe von KI

Beschleunigung der Entwicklung durch Zentralisierung von Daten, Vereinfachung der Datenerfassung und des Datenzugriffs und Erhöhung der Interoperabilität

Stärkung von Compliance-Prozessen und Resilienz durch Sicherheits- und Governance-Funktionen in Enterprise-Qualität und Verwaltbarkeit im großen Maßstab

Schnellere Einblicke durch verbesserte Erfassungs- und Abfrage-Performance bei gleichzeitig gesteigerter Kostentransparenz im großen Maßstab

Schauen wir uns einmal genauer an, wie wir Daten ohne Limits verfügbar machen.

Optimieren Sie Datenmigrationen mit KI, um Datenflexibilität und -zugänglichkeit zu verbessern.

Das Verschieben von Daten aus Altsystemen ist oft ein langsames, teures und riskantes Unterfangen, insbesondere wenn es um komplexen, voneinander abhängigen Code und Schemata geht. Wir nehmen Ihnen diese Kopfschmerzen, indem wir KI direkt in unsere Migrationstools integrieren.

SnowConvert AI bietet jetzt einen schnelleren, vorhersehbareren und kostengünstigeren Migrationspfad, sodass vertrauenswürdige Daten schnell in die Hände Ihrer Entwickler:innen gelangen. KI-gestützte Codeüberprüfung und -reparatur (in Public Preview) beschleunigt die Migration, indem der mühselige und zeitaufwendige Prozess des Testens und Reparierens von konvertiertem Code automatisiert wird. So können Sie vor der Bereitstellung Genauigkeit und Qualität gewährleisten. Automatische und inkrementelle Codevalidierung (allgemein verfügbar) überprüft automatisch umgewandelten Code in kleineren Schritten auf semantische Äquivalenz und steigert so das Vertrauen in Ihre Daten erheblich.

Wir erweitern auch die Unterstützung von SnowConvert AI über die Datenbank hinaus, um eine End-to-End-Ökosystemmigration zu ermöglichen – einschließlich Legacy-ETL und BI-Repointing, bei dem Berichte aktualisiert werden, sodass sie die neue Datenbank verwenden (in Public Preview). Dieser umfassende Support hilft Ihnen, Risiken zu reduzieren und die Einheitlichkeit in Ihrer gesamten Datenumgebung zu erhöhen. Gleichzeitig können Sie die Zeit und die Kosten für den Abschluss einer Migration drastisch reduzieren, ohne Abstriche bei der Qualität zu machen.

Beschleunigen Sie die Entwicklung mit vereinfachten Workflows und erweiterter Interoperabilität im gesamten Enterprise Lakehouse

Für moderne App-Entwicklung müssen Sie keine Pipeline-Orchestrierungs-Expert:in sein. Sie brauchen eine optimierte Umgebung, in der Transaktions- und Analysedaten zusammengeführt werden und in der Sie problemlos mit Open-Data-Formaten arbeiten können – unabhängig von der Engine oder Cloud.

Hier werden vereinfachte Workflows und echte Interoperabilität zu Unterscheidungsmerkmalen. Wir definieren das Enterprise Lakehouse neu, indem wir Daten-Workloads vereinheitlichen, die Unterstützung für offene Standards ausweiten und mehr Konnektoren und Bereitstellungsoptionen hinzufügen, um End-to-End-Pipelines zu optimieren. Letztlich besteht das Ziel darin, Ihnen die Flexibilität zu geben, das zu entwickeln, was Sie brauchen, wie Sie es brauchen, wann Sie es brauchen.

Unterstützen Sie betriebliche Workloads und vereinheitlichen Sie Daten mit Snowflake Postgres

Postgres hat sich als führende Datenbank unter Entwickler:innen und als Rückgrat für die moderne Anwendungsentwicklung etabliert. Sie wissen bereits, dass Snowflake Postgres (demnächst in Public Preview) Postgres in die Snowflake AI Data Cloud bringt. Es liefert Ihren Entwickler:innen das Postgres, das sie sich wünschen, auf der Plattform in Enterprise-Qualität, die Ihr Unternehmen benötigt, und erleichtert die Verbindung von Daten zwischen Ihren Transaktions- und Analysesystemen. Dank der vollständigen Kompatibilität mit Open-Source-Postgres können Sie Ihre betrieblichen Workloads auf Snowflake ausführen, ohne Code neu zu schreiben. Entwickler:innen können weiterhin die spezifischen Postgres-Erweiterungen, ORMs und Clients/Frameworks verwenden, von denen sie abhängig sind. Jetzt können Sie intelligentere Anwendungen und kontextbewusste AI Agents mit aktuellen Transaktionsdaten entwickeln, während Sie gleichzeitig Ihre Architektur vereinfachen und Innovationen auf einer einzigen Plattform beschleunigen.

Außerdem kündigen wir pg_lake an, eine Reihe von Open-Source-Postgres-Erweiterungen, mit denen Entwickler:innen Postgres für die Interaktion mit Ihrem Lakehouse verwenden können. Mit pg_lake kann Postgres Ihre analytischen Daten direkt dort abfragen, wo sie sich im Objektspeicher befinden. Dazu können Sie Standard-SQL verwenden, um Apache Iceberg™-Tabellen zu lesen und zu schreiben und Daten direkt aus Dateiformaten wie CSV, Parquet oder JSON abzufragen oder zu laden. Mit pg_lake bringen wir die Leistung von Postgres in Ihr Lakehouse.

Höhere Interoperabilität

Für ein wirklich benutzerfreundliches, vernetztes und zuverlässiges Enterprise Lakehouse müssen Ihre Daten universell verfügbar und interoperabel sein – über verschiedene Engines und Cloud-Plattformen hinweg. Snowflake hat immer wieder auf die Vorteile von sicherem cloud- und regionsübergreifendem Datenzugriff und Data Sharing hingewiesen. Dank der Unterstützung von Snowflake Horizon Catalog für externen Lesezugriff (demnächst in Public Preview) und Schreibzugriff (demnächst in Private Preview) auf von Snowflake verwaltete Iceberg-Tabellen über offene APIs von Apache Polaris (Incubating) und den Apache Iceberg REST Catalog verbessern wir nun die Interoperabilität ohne Lock-in. Dies erleichtert den Zugriff auf von Snowflake verwaltete Iceberg-Tabellen über externe Abfrage-Engines, die das Iceberg REST-Protokoll unterstützen, erheblich. Anstatt ein separates Apache-Polaris-Konto einzurichten, die Integration zu konfigurieren, einen separaten Satz von Benutzer:innen und Rollen zu verwalten und separate Sicherheitseinstellungen einzurichten, können Sie jetzt einfach direkt über Horizon Catalog in Ihrem Snowflake-Konto auf die Tabellen zugreifen.

Außerdem erweitern wir unsere Zero-ETL-Funktionen für Data Sharing auf offene Tabellenformate (allgemein verfügbar), einschließlich Apache Iceberg- und Delta Lake-Tabellen, unabhängig davon, in welchem Metadatenkatalog sich die Daten befinden. Die Unterstützung der neuesten Apache Iceberg V3-Funktionen (in Private Preview), wie z. B. neue Varianten und Geodatentypen, eröffnet noch mehr Anwendungsfälle für Ihre Iceberg-Tabellen.

Snowflake führt außerdem ein neues Maß an Unternehmensdatenschutz für Ihr Lakehouse ein. Unsere Business Continuity/Disaster Recovery (BCDR) für von Snowflake verwaltete Iceberg-Tabellen (in Public Preview) ermöglicht es Ihnen, asynchrone Kopien von Kontoobjekten und Datenbanken über Regionen und Clouds hinweg zu erstellen und Failover-Gruppen zu bilden. Dank dieser robusten Resilienz- und Wiederherstellungsfunktion bleiben Ihre Daten bei einer Katastrophe oder einem Cloudausfall zugänglich – und Ihr Geschäft läuft weiter.

Optimierte Pipelines und angereicherte Datenbereitstellung

Durch die Vereinfachung von End-to-End-Daten-Pipelines können Sie Daten aus mehr Quellen beziehen und sie schneller in die Hände von Datenteams legen. Kombinieren Sie das mit der Möglichkeit, schnell angereicherte Datenprodukte zu entwickeln und zu teilen, und Sie erhalten einen erheblichen Schub für Ihre Agentic AI-Initiativen.

Snowflake Openflow befasst sich mit dem ersten Teil des Prozesses, bei dem Datenextraktion und -integration aus praktisch jeder Quelle automatisiert und die Zentralisierung der Daten im gesamten Enterprise Lakehouse vereinfacht werden. Openflow war bisher allgemein mit der Bereitstellungsoption Bring Your Own Cloud (BYOC) auf AWS verfügbar, und die Snowflake-Bereitstellungsoption über Snowpark Container Services ist jetzt allgemein auf AWS und Microsoft Azure verfügbar. Die Openflow-Snowflake-Bereitstellung bietet eine vollständig integrierte Erfahrung, sodass sich Data Engineers nicht mehr um die Verwaltung der Infrastruktur, die Konfiguration von Netzwerken oder um Sicherheitsgrenzen zwischen Systemen kümmern müssen.

Snowflake fügt außerdem neue Integrationsoptionen in seine umfangreiche Bibliothek von Konnektoren und Bereitstellungsoptionen ein, die alle darauf abzielen, eine effiziente Verbindung zu Ihren Daten herzustellen und diese zu nutzen:

Einheitliche Zero-Copy-Unternehmensdatenintegration: SAP Snowflake (in Private Preview) erweitert die SAP Business Data Cloud um vollständig verwaltete Daten- und KI-Funktionen und vereinfacht die Unternehmensdatenlandschaft durch eine bidirektionale Integration. Darüber hinaus haben wir uns mit Oracle (demnächst in Public Preview) zusammengetan, um eine neue CDC-Kollaboration für schnelle Datenreplikation über On-Premises- und Cloud-Umgebungen hinweg auszuweiten.

dbt projects on Snowflake (allgemein verfügbar): Erstellen, testen, implementieren und überwachen Sie dbt-Projekte zur Datentransformation direkt in Snowflake, damit sich Data Engineers auf die Bereitstellung von Einblicken konzentrieren können, anstatt die Infrastruktur zu pflegen.

Snowpark Connect für Apache Spark™ (allgemein verfügbar): Nutzen Sie den Open-Source-Client von Spark Connect, um Ihren Apache-Spark-Code mit minimalen Änderungen direkt auf Snowflake auszuführen. Snowpark-Kunden erzielen im Durchschnitt eine 5,6-mal schnellere Performance und 41 % Kosteneinsparungen.1

Sobald Entwickler:innen auf all diese Daten zugreifen können, benötigen sie eine zuverlässige, aber einfache Möglichkeit zur Zusammenarbeit und effizienten Iteration ihrer Projekte. Das Erstellen und Teilen fortschrittlicher Datenprodukte ist eine effiziente Möglichkeit, angereicherte Daten bereitzustellen. Neben der Freigabe von Datenbanken, Tabellen und sicheren Ansichten als Datenprodukte können Sie Snowflake Notebooks und UDFs jetzt ganz einfach verpacken und freigeben, indem Sie die Declarative-Sharing-Konfiguration (demnächst allgemein verfügbar) im Snowflake Native App Framework verwenden.

Verbessern Sie Ihre Compliance-Initiativen mit Innovationen in den Bereichen Sicherheit, Governance und Resilienz auf Unternehmensniveau.

Wenn Sie mehr Daten verbinden und Ihre KI-Initiativen skalieren, steigen die Anforderungen an Sicherheit, Governance und Geschäftskontinuität. KI braucht saubere, genaue Daten für das Training. Robuste Resilienz und Datensicherheit sind grundlegende Voraussetzungen – und Compliance ist nicht optional.

Snowflake Horizon Catalog ist der universelle KI-Katalog, der Kontext und Governance für KI in all Ihren Daten bereitstellt. Sie bietet Interoperabilität ohne Bindung an ein Enterprise Lakehouse und stellt Sicherheits- und Governance-Funktionen auf Enterprise-Niveau für Daten und KI bereit. Horizon Catalog hilft KI auch dabei, Ihre Daten besser zu verstehen, indem es den fehlenden Kontext bereitstellt, der AI Agents dabei hilft, Daten richtig zu interpretieren. Zu guter Letzt ermöglicht Horizon Catalog regions- und cloudübergreifende Verwaltbarkeit und umfassendes Sharing mit der Verwaltung aller Konten in Ihrem Unternehmen, nahtlose Zusammenarbeit und BCDR über Clouds und Regionen hinweg.

Zu den neu verfügbaren Funktionen von Horizon Catalog gehört AI Redact (in Public Preview), eine KI-SQL-Funktion zum Erkennen und Unkenntlichmachen personenbezogener Daten (PII) in unstrukturierten Daten. Dies beseitigt unmittelbar ein großes Hindernis für eine schnelle Einführung von Unternehmens-KI, da PII in den unstrukturierten Daten geschützt wird, auf die KI-Modelle für das Training angewiesen sind, und hilft Unternehmen, einen größeren Teil ihrer Unternehmensdaten KI-ready zu machen. Wir kündigen außerdem Data Security Posture Management (in Public Preview) an, eine einfache Benutzeroberfläche im Trust Center, mit der Sie sensible Daten erkennen, kennzeichnen, schützen und überwachen können.

Weitere Verbesserungen für Horizon Catalog, jetzt in Public Preview, sind die Einsicht in externe Datenherkunft und eine vereinfachte Benutzeroberfläche für Datenqualität in der Snowsight-Oberfläche mit einer Registerkarte für automatisches Datenprofiling. Eine neue Benutzeroberfläche zur Anomalieerkennung (in Public Preview) zentralisiert Sicherheitsabweichungen in allen Konten im Unternehmen und warnt Sie vor neuen. Weitere Aktualisierungen im Trust Center umfassen:

Erstellung von Trust-Center-Erweiterungen von Drittanbietern (in Public Preview) und Bereitstellung für andere Snowflake-Kunden über Snowflake Marketplace

Global Org Admin kann die Sicherheitshaltung aller Konten im Organisationskonto einsehen (demnächst allgemein verfügbar)

Die Unterstützung der Sicherheit steht auch im Mittelpunkt der Snowflake-Erweiterungen für hybride Tabellen. Hybrid Tables sind jetzt allgemein auf Microsoft Azure verfügbar, und sie unterstützen auch das Tri-Secret Secure (TSS)-Verschlüsselungsmodell von Snowflake (allgemein verfügbar auf AWS, in Public Preview auf Microsoft Azure). TSS schützt Daten mit der integrierten Benutzerauthentifizierung von Snowflake und einem Composite Master Key, der einen von Snowflake verwalteten Schlüssel mit einem von Kunden verwalteten Schlüssel kombiniert und so ein höheres Maß an Sicherheit bietet. Darüber hinaus helfen die automatischen Rekeying-Funktionen von Hybrid Tables (allgemein verfügbar auf AWS und Azure) Entwickler:innen, Sicherheits- und Compliance-Standards einzuhalten, indem die Verschlüsselungsschlüssel automatisch und regelmäßig geändert werden.

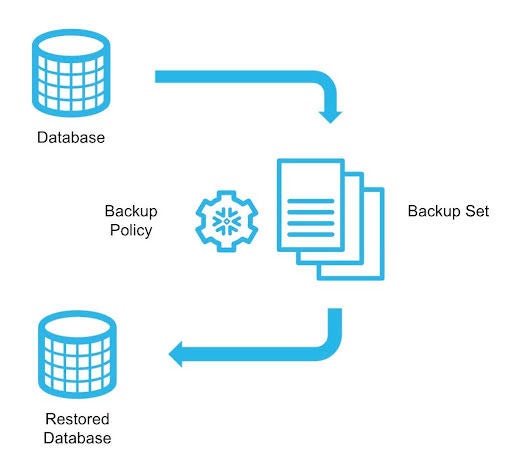

Auf der Seite der geschäftlichen Resilienz erhalten Sie mit Snowflake Backups (demnächst allgemein verfügbar) ein leistungsstarkes Tool zur Stärkung der Cyberresilienz, zur Unterstützung der Compliance und zur Verbesserung der Datenintegrität für Audits oder zu rechtlichen Zwecken. Sie können Point-in-Time-Backups erstellen und sie so einrichten, dass sie unveränderlich sind, d. h. sobald sie erstellt wurden, können sie nicht mehr geändert oder gelöscht werden – selbst nicht von Administrator:innen. Im Falle eines Ransomware-Szenarios, einer Naturkatastrophe oder eines Ausfalls können Sie Backups mit den Account-Replikationsfunktionen von Snowflake kombinieren, sodass alle Backup-Sets und -Richtlinien in eine andere Region oder zu einem anderen Cloud-Anbieter repliziert und wiederhergestellt werden können.

Erhalten Sie schnellere Einblicke durch verbesserte Erfassungs- und Abfrage-Performance und verbesserte Kostentransparenz in großem Umfang

Geschwindigkeit und Kosteneffizienz wirken sich direkt auf Ihr Geschäftsergebnis und Ihre Fähigkeit aus, Mehrwert für Ihre Benutzer:innen zu liefern. Wenn Sie mit Echtzeit-Datenstreams arbeiten und schwere analytische Workloads ausführen, ist die skalierbare Performance besonders entscheidend.

Erfüllung der Daten- und Performanceanforderungen von Agentic AI-Apps

Snowflake stellt kontinuierlich automatische Verbesserungen auf der Plattform bereit, um sicherzustellen, dass Ihre Daten-Pipelines und Abfragen schneller ausgeführt werden.

Die Vorteile beginnen mit den intelligenten Optimierungsfunktionen von Snowflake Optima auf Snowflake Standard Warehouse Generation 2 (Gen2), die eine schnellere Abfrageperformance für Analytics- und Data-Engineering-Workloads bieten. Dazu gehört Optima Indexing (allgemein verfügbar), das Ihre Workloads analysiert und proaktiv wiederkehrende Point-Lookup-Abfragen identifiziert, die beschleunigt werden können. Dank Snowflake Optima erlebte ein Kunde aus der Automobilbranche eine 15-fache Beschleunigung bei häufig wiederkehrenden, hochselektiven Abfragen von Gen2-Warehouses.

Für Streaming-Workloads unterstützt Snowflake Streaming V2, die neueste Version unseres Next-Gen-Frameworks zur Datenerfassung (allgemein verfügbar auf AWS, mit Azure und GCP in Kürze), eine vereinfachte Architektur, die in einem kürzlich veröffentlichten Benchmark-Test eine 56 %ige Verringerung der Abfrageausführungszeit und eine bessere End-to-End-Latenz bietet.2 Außerdem haben wir ein vorhersehbareres, nutzungsbasiertes Preismodell eingeführt, mit dem Teams die Gesamtausgaben reduzieren können.

Snowflake Dynamic Tables vereinfachen Daten-Pipelines, indem Sie mit einer einzigen SQL-Abfrage den gewünschten Status definieren. Mit den neuen Unveränderlichkeitsfunktionen (allgemein verfügbar) können Sie Bereiche der Tabellen sperren, damit sie sich bei Aktualisierungen nicht ändern, was zu weniger Rechenaufwand und geringeren Kosten führt. Dynamic Iceberg Tables (allgemein verfügbar) lassen sich in Data Lakes integrieren, sodass Sie Daten in einem externen Cloudspeicher (AWS S3, Azure Blob Storage usw.) speichern können, während sie von Snowflake verwaltet werden.

Kosten im Blick

Heutzutage stellen Entwickler:innen fest, dass sie im Rahmen ihrer KI-Initiativen häufig die Cloud-Kosten im Blick behalten müssen. Snowflake-Kunden können nun den Verbrauch mit Tools verwalten, die sich in die Details vertiefen, darunter die Durchführung detaillierter Kostenzuweisungen für freigegebene Ressourcen (in Private Preview) über alle Snowflake-Konten ihres Unternehmens per SQL. Mit neuen Tag-basierten Budgets können Unternehmen Budgets für Nutzende freigegebener Ressourcen festlegen (demnächst in Private Preview), um den Verbrauch freigegebener Ressourcen auf Benutzer:innenebene zu überwachen und Kostenüberschreitungen zu verhindern.

Keine KI-Strategie ohne Datenstrategie

Snowflake setzt neue Maßstäbe, wenn es darum geht, eine einfache, vernetzte und vertrauenswürdige Datengrundlage zu schaffen, um unternehmenstaugliche Daten und KI zu beschleunigen. Entwickler:innen haben eine zentrale, KI-taugliche Plattform, mit der sie ganz einfach mehrere Datentypen aus verschiedenen Quellen migrieren, darauf zugreifen und verbinden können, um Agentic AI-Apps zu entwickeln – und das mit blitzschneller Performance, hoher Skalierbarkeit und effektivem Kostenmanagement.

Erfahren Sie mehr darüber, wie Sie mit der AI Data Cloud mithilfe neuer Funktionen, die intelligente, kontrollierte KI in großem Umfang bereitstellen und den Entwicklerworkflow modernisieren, besser und schneller entwickeln können. Um diese Funktionen in Aktion zu sehen, sehen Sie sich die BUILD 2025 Agenda an und nehmen Sie an einer der vielen ausführlichen Sessions oder Hands-on-Labs teil.

______________

1 Basierend auf Produktions-Anwendungsfällen von Kunden und Proof-of-Concept-Projekten, in denen die Geschwindigkeit und die Kosten von Snowpark im Vergleich zu verwalteten Spark-Services zwischen November 2022 und Mai 2025 verglichen werden. Alle Ergebnisse basieren auf tatsächlichen Kundenergebnissen mit realen Daten und repräsentieren keine fiktiven, als Benchmarks verwendeten Datasets.

Der 2 Benchmark-Bericht basiert auf dem TPC-DS-Benchmark und ist daher inoffiziell und wird nicht vom Transaction Processing Performance Council validiert oder zertifiziert. Diese Ergebnisse dienen nur der Information und sind nicht mit offiziellen Ergebnissen von TPC-DS vergleichbar.

Zukunftsgerichtete Aussagen

Dieser Artikel enthält zukunftsgerichtete Aussagen, unter anderem über künftige Produktangebote. Diese Aussagen stellen keine Garantie dar, dass diese Angebote wirklich bereitgestellt werden. Die tatsächlichen Ergebnisse und Angebote können abweichen und unterliegen bekannten und unbekannten Risiken und Unsicherheiten. Weitere Informationen finden Sie in unserem jüngsten 10-Q-Formular.