Blog

Créez, déployez et distribuez des modèles à grande échelle avec Snowflake ML

Découvrez les dernières fonctionnalités disponibles pour tous nos clients pour la création et le déploiement de modèles à grande échelle dans Snowflake.

FONCTIONNALITÉ

Accélérez le machine learning, du prototype à la production, avec des GPU ou des CPU distribués sur la même plateforme que vos données gouvernées. Simplifiez le développement de modèles et les MLOps sans infrastructure à maintenir ou à configurer, le tout grâce à une interface utilisateur centralisée.

Présentation

Développez, déployez et surveillez des features et modèles de ML à l’aide d’une plateforme entièrement intégrée qui rapproche les outils, les flux de travail et l’infrastructure de calcul des données.

Unifiez les pipelines de modèles de bout en bout avec n'importe quel modèle open source sur la même plateforme que celle où vos données se trouvent.

Faites évoluer les pipelines de ML sur des CPU ou des GPU grâce à des optimisations intégrées de l’infrastructure, sans réglage ni configuration manuels.

Découvrez, gérez et gouvernez des features et des modèles dans Snowflake tout au long de leur cycle de vie.

Flux de travail de ML

Développement de modèles

Optimisez le chargement des données et distribuez l’entraînement de modèles à partir de Snowflake Notebooks sur Container Runtime ou de tout IDE de votre choix avec ML Jobs.

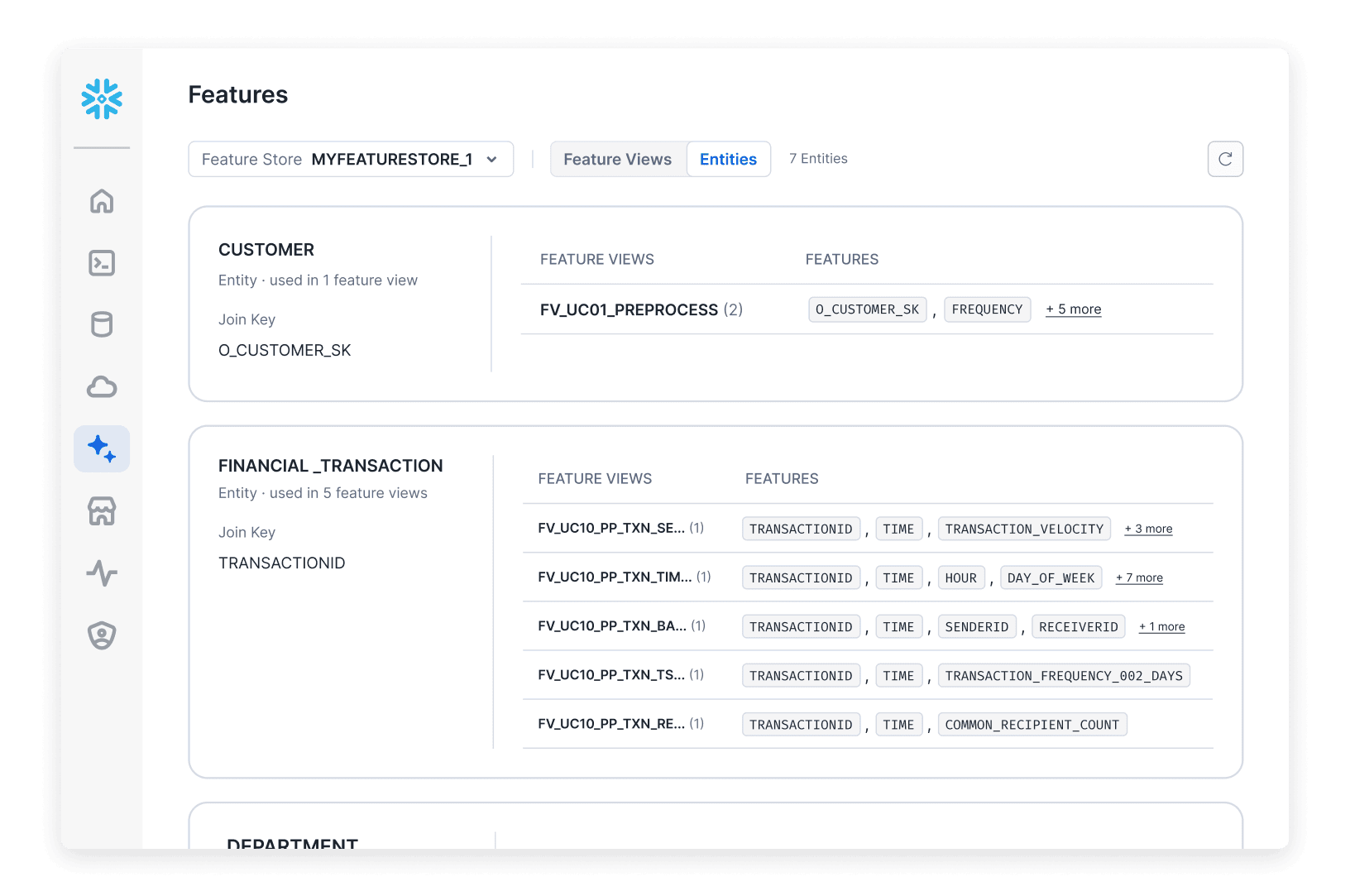

Gestion de features

Créez, gérez et proposez des features de ML avec une actualisation continue et automatisée des données par batch ou en streaming à l’aide du Snowflake Feature Store. Favorisez la découvrabilité, la réutilisation et la gouvernance des features à travers l’entraînement et l’inférence.

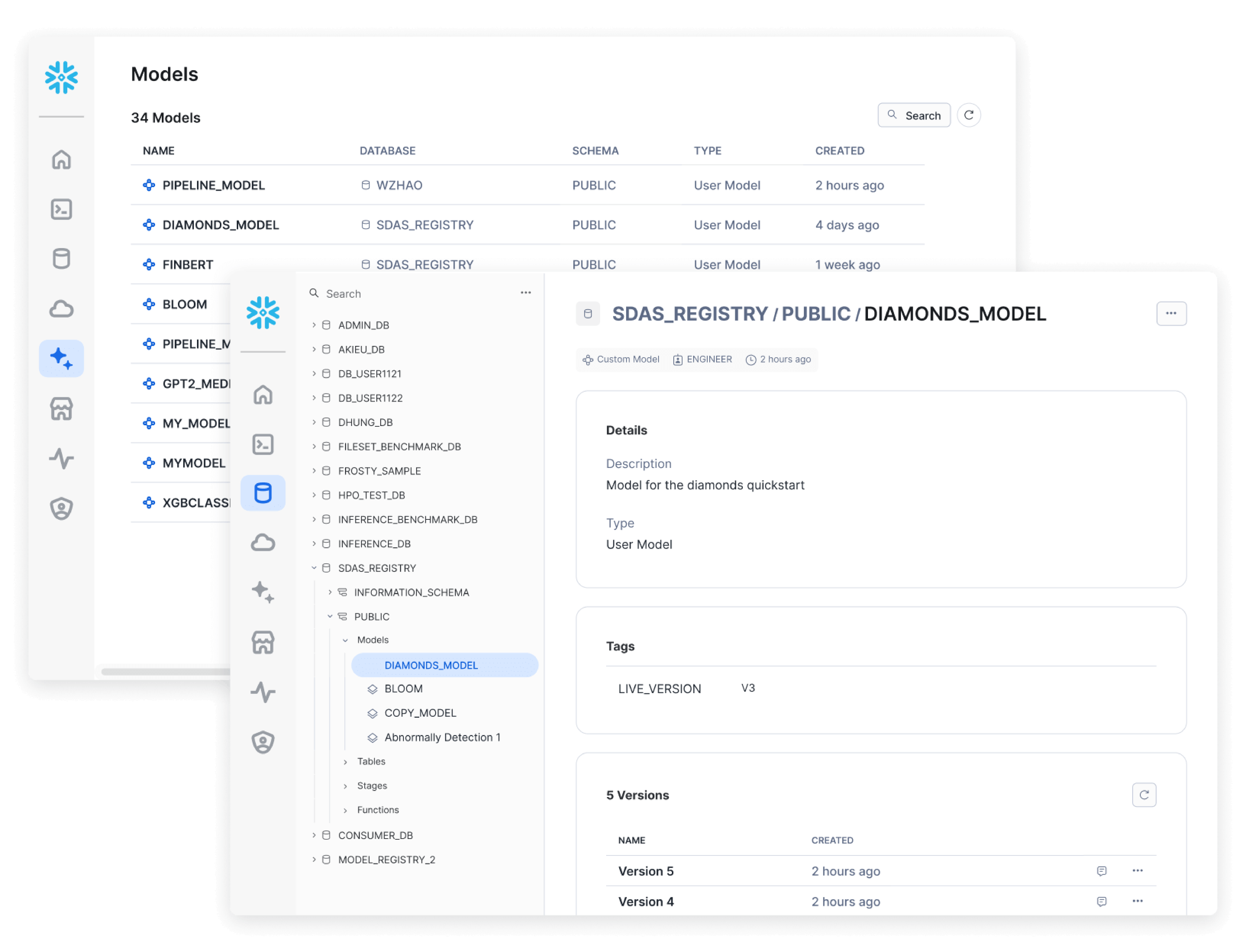

Production

Enregistrez les modèles créés n’importe où dans Snowflake Model Registry pour les prédictions en temps réel ou par batch sur les données Snowflake avec des GPU ou des CPU distribués.

En savoir plus sur les fonctionnalités intégrées pour le développement

et la production dans Snowflake ML

Premiers pas

ML de bout en bout

Oui, les data scientists et les ML engineers peuvent créer et déployer des modèles avec traitements distribués dans des CPU ou GPU. C’est possible grâce à l’infrastructure sous-jacente en conteneurs de la plateforme Snowflake ML.

Vous pouvez créer des features et des modèles directement à partir de Snowflake Notebooks, ou via n’importe quel IDE de votre choix avec ML Jobs.

Non, vous pouvez utiliser des modèles créés n’importe où en externe pour les exécuter en production sur des données Snowflake. Pendant l’inférence, vous pouvez tirer parti des fonctionnalités de MLOps intégrées telles que l’observabilité du ML et la gouvernance RBAC.

Oui, Snowflake ML est entièrement compatible avec toutes les bibliothèques open source. Accédez de manière sécurisée à des référentiels open source via pip et intégrez n’importe quel modèle à partir de hubs tels que Hugging Face.

Snowflake fonctionne sur un modèle de tarification à la consommation. Consultez ici le dernier tableau de tarification des crédits.

Oui, vous pouvez essayer l’un de nos quickstarts sur le ML directement avec votre essai gratuit.