FEB 03, 2026|Lesezeit: 8 Minuten

Modernisierung des ML-Stack: Neue agentische, multimodale und Echtzeit-Workflows

Traditionelles maschinelles Lernen (ML) ist in der modernen KI-Landschaft nach wie vor von entscheidender Bedeutung und dient als Rückgrat für die prädiktiven Einblicke, die den unternehmerischen Mehrwert steigern – von der Lieferkettenoptimierung bis hin zur Betrugserkennung in Echtzeit. Der Weg vom Experiment zur Produktion bleibt jedoch herausfordernd: Die fragmentierten Tools im gesamten Ökosystem erfordern komplexe Einrichtung, mehrere Iterationen zur Optimierung und laufende Wartung. Wir bei Snowflake legen großen Wert darauf, eine moderne ML-Plattform bereitzustellen, die eng mit Ihren Daten integriert ist, um einheitliche Sicherheitsmaßnahmen zu ermöglichen und Workflows zu beschleunigen, die mit Ihren Geschäftsanforderungen skaliert werden können.

Wir freuen uns, bekannt geben zu können, dass die folgenden Funktionen für Ihre Modellworkflows in Snowflake ML jetzt verfügbar sind:

Automatisierter Entwicklung voll funktionsfähiger ML-Pipelines mit einfachen Prompts in natürlicher Sprache aus einer Jupyter-basierten Umgebung in Snowflake Notebooks (allgemein verfügbar) mit Cortex Code in Snowsight (demnächst allgemein verfügbar)

Effiziente Bereitstellung des leistungsstärksten Modells, indem Sie das nativ integrierte Experiment Tracking (allgemein verfügbar) nutzen, um Top-Ergebnisse über Trainingsläufe hinweg einfach zu identifizieren, freizugeben und zu reproduzieren

Mit dem Online Snowflake Feature Store (allgemein verfügbar) und der Online-ML-Inferenz (allgemein verfügbar) können Sie Prognosen mit niedriger Latenz in Millisekundenschnelle bereitstellen, um Anwendungsfälle wie personalisierte Empfehlungen und Betrugserkennung in Echtzeit umzusetzen.

Ausführung von Inferenz-Workloads für multimodale Modelle (Public Preview), um Inferenz in großem Maßstab mit unstrukturierten Daten wie Bildern und Audio zu ermöglichen

Agentengestützte Modellentwicklung

Wir bei Snowflake investieren weiterhin in moderne Entwicklungserfahrungen, die die Produktivität der Entwickler:innen steigern. Heute gestalten wir Produktions-ML um mit der Einführung von Agenten-ML-Funktionen, die mit einer brandneuen integrierten Entwicklungsumgebung (IDE) in Snowflake Notebooks integriert sind.

Cortex Code for ML Pipelines

Data Scientists verbringen oft lange Zyklen mit der Entwicklung und Fehlerbehebung ihrer ML-Workflows, was zu betrieblichen Engpässen führt und weniger ML-Modelle in die Produktion bringt. Snowflake bringt nun Agenten-KI für ML-Workflows aus Cortex Code in Snowsight (demnächst allgemein verfügbar) für ML-Workflows in Snowflake Notebooks mit, um eine vollständig ausführbare ML-Pipeline aus einfachen Prompts in natürlicher Sprache autonom zu iterieren, anzupassen und zu generieren.

Cortex Code unterteilt Probleme im Zusammenhang mit ML-Workflows in verschiedene Schritte, wie Datenanalyse, Datenaufbereitung, Feature Engineering und Training. Cortex Code kombiniert fortschrittliche Techniken wie mehrstufiges Denken, Kontextverständnis und Aktionsausführung und bietet verifizierte Lösungen in Form von voll funktionsfähigen ML-Pipelines, die einfach von einem Snowflake Notebook aus ausgeführt werden können. Cortex Code bietet Verbesserungsvorschläge oder von den Nutzenden bereitgestellte Follow-ups, mit denen Nutzende ganz einfach zur nächstbesten Version wechseln können. Durch die Automatisierung dieser mühsamen Arbeit sparen Data-Science-Teams Stunden an Zeit, die sie normalerweise für Experimente oder Fehlerbehebungen aufwenden würden – und können sich stattdessen auf Initiativen konzentrieren, die größere Auswirkungen haben.

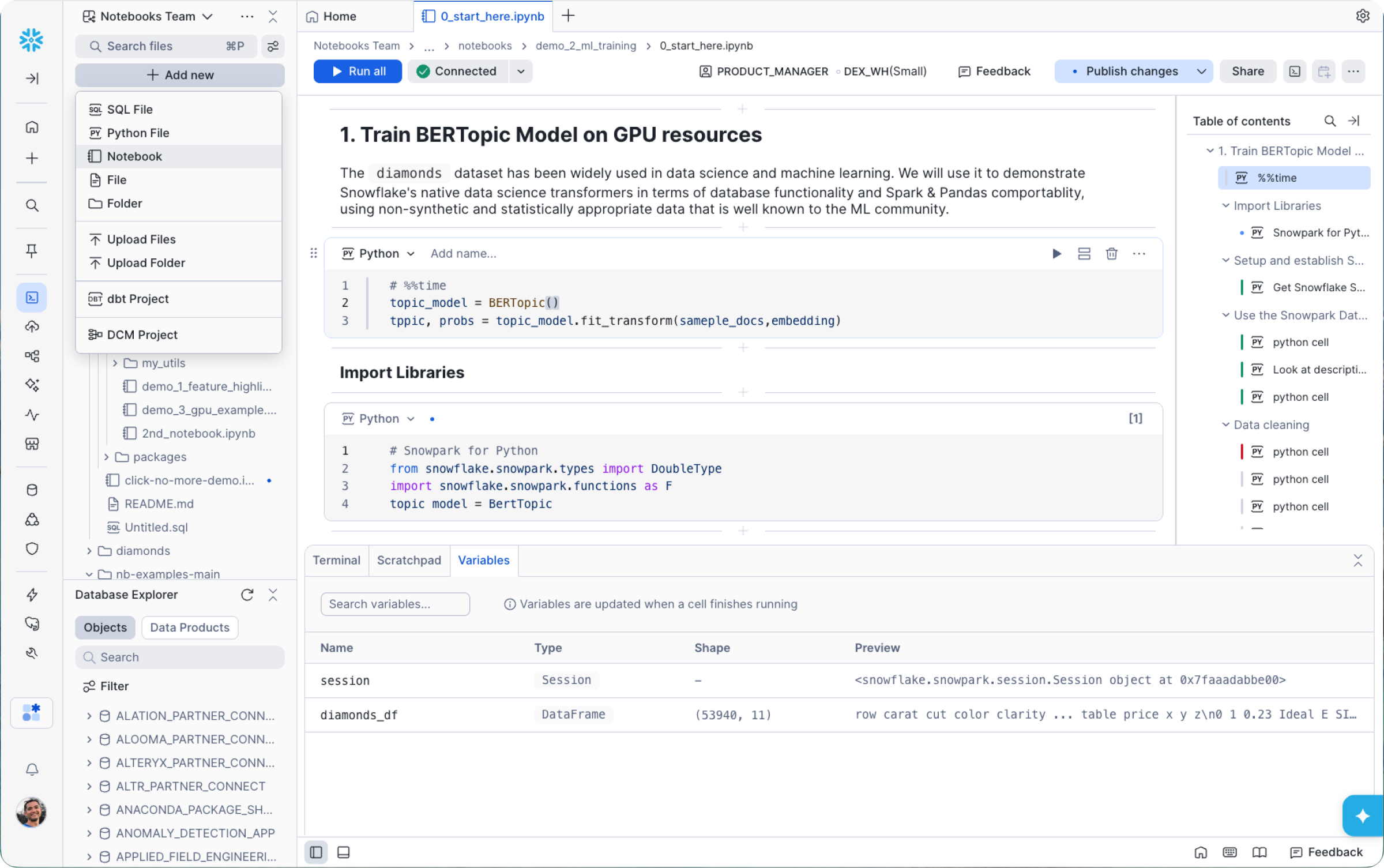

Snowflake Notebooks

Cortex Code kann direkt aus Snowflake Notebooks für die Erstellung und Iteration von Produktionsworkflows genutzt werden. Die Entwicklung der nächsten Generation für Snowflake Notebooks ist jetzt allgemein in Workspaces verfügbar. Mit diesen Jupyter-basierten Notebooks können Sie vorhandene Notebooks, Skripte und Modelltrainings in die einheitliche Plattform von Snowflake integrieren, während Sie Ihre bevorzugten Bibliotheken, Jupyter-Laufzeitfunktionen und vertrauten IDE-Attribute sowie die dateibasierte Organisation in Workspaces beibehalten.

Diese neue Entwicklungserfahrung beinhaltet folgende Verbesserungen:

Verwalteter Jupyter/IPython-Kernel: Notebooks werden jetzt auf einem von Snowflake verwalteten Jupyter/IPython-Kernel ausgeführt, was die Kompatibilität mit Magics und vorhandenen Notebooks gewährleistet. Dazu gehören die Ausführung von SQL-, Python- und Markdown-Code und die einfache Übertragung von Daten zwischen Zellen. Zeigen Sie Ihre Ergebnisse im Ergebnis-Explorer unter jeder Zelle mit Tabellen und einem Visualisierungs-Builder an.

Workspace-native Organisation: Notebooks können jetzt direkt in Workspaces erstellt werden, zusammen mit Ihren SQL-Dateien, dbt-Projekten und Python-Dienstprogrammen sowie allen anderen Assets, die Sie zur Entwicklung auf Snowflake verwenden. So können Sie alles an einem Ort organisieren und sorgen dafür, dass sich Multi-File-Workflows natürlich anfühlen. Sie können Logik in Hilfsfunktionen refaktorieren, Workflows in kleinere Komponenten zerlegen und sie nach Bedarf zusammenfügen. Unser neues Terminal und unser Variablen-Explorer sorgen außerdem für eine schnellere und produktivere Entwicklungsschleife.

Nahtlose Git-gestützte Zusammenarbeit: Mit Git-gestützten Workspaces können Sie nun nahtlos in Ihrem gesamten Repository arbeiten – Branchen, Committen und Diffing direkt aus Snowflake heraus. Und wenn Git nicht Ihr bevorzugter Workflow ist, bieten Shared Workspaces eine Alternative für Ihre Teams: rollenbasierte, zugriffskontrollierte Kollaboration an einer Reihe von Dateien mit integrierter Versionierung und Änderungsverfolgung.

Möglichkeit zur Ausführung in Snowflake Container Runtime (CPU und GPU): Unsere neue Erfahrung läuft ausschließlich auf Snowflake Container Runtime, einer vorgefertigten Umgebung für Data Science und maschinelles Lernen, die direkt auf Snowpark Container Services ausgeführt wird. Es bietet eine Reihe beliebter ML-Frameworks und mehrere Python-Versionen und beschleunigt das Training und das Datenladen durch die Verteilung von Rechenressourcen. Die Laufzeitversion, mit der Sie Prototypen erstellen, ist die gleiche, mit der Sie auch planen und in Produktion bringen werden. So werden häufige Probleme wie „aber es hat auf meinem Laptop funktioniert ...“ beseitigt.

Globale Unternehmen wie Aimpoint Digital, ein führender Anbieter von Daten- und KI-Beratung, nutzen Snowflake Notebooks, um produktionsreife Entwicklungsworkflows zu fördern.

„Die allgemeine Verfügbarkeit (GA) von Snowflake Notebooks ist ein revolutionärer Moment für die Entwicklererfahrung. Wir konnten ML-Workloads – von der dynamischen Preisgestaltung bis hin zur graphenbasierten Vorhersage des Nutzerverhaltens – für Kunden mühelos entwickeln und in Produktion bringen. Die Entwicklung in Notebooks in Workspaces bedeutet, dass wir gemeinsamen Code zentralisieren können, während wir das dezentralisieren, was Entwickler darauf aufbauen. Die Möglichkeit, in Python auf SQL-Zellen zu verweisen und umgekehrt, sowie Notebooks zu parametrisieren, ist ein Paradigmenwechsel. Die Zeiten des Schedulings von Stored Procedures sind vorbei; Notebooks bieten ultimative Flexibilität für dynamische Workflows, egal ob in den Bereichen ML, KI oder Engineering.“

Christopher Marland

Snowflake Practice Lead, Aimpoint Digital

Um mit Snowflake Notebooks zu beginnen, empfehlen wir diesen Quickstart zur Modellierung.

Experiment Tracking

Nach der Erstellung und Iteration mit Snowflake Notebooks und Cortex-Code können Sie mithilfe des nativ integrierten Experiment Tracking (jetzt allgemein verfügbar) schnell von einer Rohhypothese zu einem leistungsstarken Modell wechseln. So können ML-Teams systematisch die leistungsstärksten Modelle für verschiedene Trainingsläufe identifizieren, freigeben und reproduzieren. Das vereinfacht die Zusammenarbeit, verbessert die Reproduzierbarkeit und beschleunigt die Modelliterationen im gesamten Unternehmen. Mit der neuesten Version von Snowflakes Experiment Tracking können Sie Millionen von Metriken, die während großer Trainingsläufe generiert wurden, sowie Modellparameter, Artefakte und Metadaten nahtlos protokollieren.

Viele Unternehmen nutzen Experiment Tracking, um kritische Informationen für das Modelltraining über verschiedene Durchläufe hinweg zu speichern, zu verfolgen und zu vergleichen. Dazu gehört auch EnergyHub, mit dem Versorgungsunternehmen und ihre Kunden eine saubere, dezentrale Energiezukunft schaffen können.

„Als Early Adopter des Experiment Tracker von Snowflake haben wir festgestellt, dass er unsere Anforderungen erfüllt und uns gleichzeitig den Aufwand erspart, einen separaten MLFlow-Server betreiben zu müssen. Die Konsolidierung des ML-Experiment-Trackings innerhalb unserer bestehenden Snowflake-Plattform war ein bedeutender operativer Gewinn. Darüber hinaus hat Snowflake unglaublich gut auf Feedback reagiert und Verbesserungen in beeindruckendem Tempo eingeführt.“

Dr. Wiliam Franklin

Principal Machine Learning Scientist, EnergyHub

Echtzeit-Bereitstellung

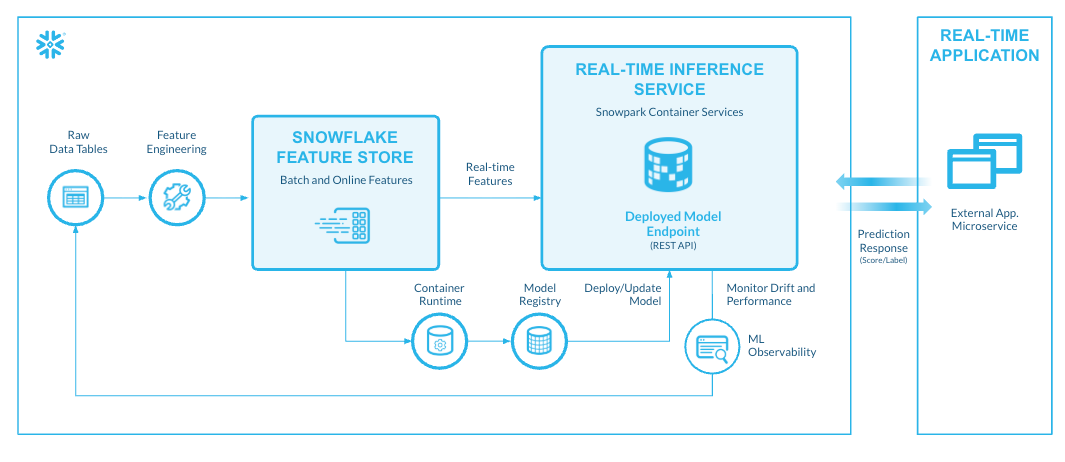

Sobald Sie Ihr Modell in Snowflake oder einer anderen externen Plattform trainiert haben, können Sie es ganz einfach zur Inferenz auf Snowflake-Daten bereitstellen, um vorhersagende Ergebnisse zu generieren. Wir führen neue produktionsbereite Online-ML-Funktionen ein, die allgemein verfügbar sind, um Anwendungsfälle wie personalisierte Empfehlungen und Betrugserkennung in Echtzeit zu ermöglichen – keine zusätzliche Infrastruktur oder komplizierte Konfiguration erforderlich. Entwickler:innen können nun die Latenz-, Kosten- und Sicherheitsrisiken beim Export sensibler Daten auf externe Plattformen beseitigen, indem sie Batch- und Online-ML-Anwendungsfälle auf einer einzigen Plattform vereinen.

Snowflake Feature Store

Wir freuen uns, die allgemeine Verfügbarkeit der Online-Feature-Bereitstellung aus dem Snowflake Feature Store bekannt geben zu können. Beim Snowflake Feature Store handelt es sich um eine integrierte Lösung, mit der Data Scientists und ML Engineers ML-Features für Modelltraining und -inferenz entwickeln, speichern, verwalten und bereitstellen können. Er umfasst Python-APIs, SQL-Oberflächen zum Definieren, Verwalten und Abrufen von Features sowie eine verwaltete Infrastruktur für die Verwaltung von Feature-Metadaten und zur kontinuierlichen Feature-Verarbeitung. Snowflake Feature Store bietet eine einheitliche Lösung für Batch- und Online-Anwendungsfälle mit niedriger Latenz, die Features in 30 ms bereitstellt.

Snowflake Feature Store ist nahtlos in Ihre Snowflake-Daten, -Features und -Modelle integriert, sodass umfangreiche ML-Pipelines einfach und effizient erstellt werden können. Dadurch werden Redundanz und Duplikate von Feature-Pipelines beseitigt und sichergestellt, dass Kund:innen einheitliche, aktualisierte und genaue Features mit Sicherheits- und Governance-Funktionen auf Unternehmensniveau zur Verfügung stehen. Mit einer zentralen Benutzeroberfläche in Snowsight für die Bereitstellung von Feature Stores können Sie ganz einfach nach Features und Modellen suchen und diese entdecken und den Datenfluss über Lineage visualisieren.

Mit diesem Quickstart können Sie noch heute mit dem Snowflake Feature Store für die Bereitstellung von Onlinefunktionen beginnen.

Online-ML-Inferenz

Die Online-ML-Inferenz ist jetzt auch allgemein verfügbar, sodass Sie Modelle aus der Snowflake Model Registry zur Echtzeit-Inferenz in weniger als 100 ms bereitstellen können.

Um die hohen Anforderungen von Produktions-Workloads zu erfüllen, integriert die Online-ML-Inferenz intelligente automatische Skalierung, eine Performance mit niedriger Latenz und umfassende Beobachtbarkeit in einen kohäsiven Workflow. Das beginnt mit kosteneffizienter Performance: Unsere automatische Skalierungslogik verarbeitet sofort riesige Traffic-Spitzen und skaliert bei sinkender Nachfrage auf Null, wodurch der teure Aufwand für übermäßig bereitgestellte GPUs entfällt. Entscheidend ist, dass das System sofort reagieren kann, wenn der Datenverkehr wieder ansteigt und die Modelle schnell hochskaliert werden können, um eine Leistung von weniger als 100 ms aufrechtzuerhalten.

Die Bereitstellung ist ebenso resilient, da Benutzer durch automatische Rolling Updates zu neuen Modellversionen wechseln können. So wird sichergestellt, dass der Application Traffic nie unterbrochen wird, unterstützt durch die Sicherheit einfacher Versionsrollbacks. Teams können auch den Schattenmodus nutzen, um neue Modelle sicher zu validieren, indem sie die Performance in einer parallelen Umgebung überwachen, die von der Produktionsversion isoliert ist, bevor sie sich auf eine vollständige Umstellung festlegen. Snowflake erleichtert auch den sofortigen Einblick in Latenz, Durchsatz und Fehlerquoten mit integrierter Beobachtbarkeit, die alle Anfragen und Antworten direkt in einer Snowflake-Tabelle protokolliert, um eingehende Fehlerbehebungen und langfristige Audits durchzuführen.

Inferenz für multimodale Modelle

Darüber hinaus ist die groß angelegte Online- und Batch-Inferenz jetzt dank der Inferenzunterstützung von Snowflake für multimodale Open-Source-Modelle von Hubs wie Hugging Face ein Kinderspiel. Die Inferenzunterstützung für unstrukturierte Daten befindet sich jetzt in Public Preview und umfasst Datentypen wie Bilder, Video und Audio. Diese Funktion erschließt KI-Anwendungsfälle wie Objekterkennung, visuelle Q&A und automatische Spracherkennung in Snowflake – ganz ohne komplexe Pipelines oder Datenbewegungen.

Snowflake unterstützt sowohl Echtzeit- als auch Stapelverarbeitungsanforderungen. Benutzer können multimodale Modelle als Service für die Online-Inferenz über REST-APIs bereitstellen oder sie in der Snowflake Model Registry für den sofortigen Batch-Aufruf protokollieren. Durch die Nutzung der verteilten Rechenressourcenebene von Snowflake können Teams riesige Inferenzaufgaben über große Datasets ausführen, ohne ihre vertraute Umgebung zu verlassen.

Erste Schritte

Mit den neuesten Innovationen im Bereich der Agenten-, Online- und Multimodalfunktionen beschleunigt Snowflake ML Ihr maschinelles Lernen vom Prototyp bis zur Produktion auf derselben Plattform wie Ihre kontrollierten Daten.

Sehen Sie sich unsere Produktdokumentation an und testen Sie Snowflake ML noch heute mit diesem Einführungs-Quickstart aus der 30-tägigen kostenlosen Testversion.

Vorschläge für Sie

FEB 04, 2026|Lesezeit: 10 Minuten