人材データ向けのAI-readyガバナンス

人材データ(ワークフォースデータや従業員データと呼ばれることもあります)には、雇用ライフサイクル全体にわたる個人の詳細情報が含まれます。これは、企業において最も機密性が高く、厳格に規制されている資産の1つです。組織が従業員アナリティクスや従業員体験にAIを適用するにつれて、人材データのガバナンスに関する課題は大幅に複雑化しています。

イノベーションを鈍化させることなく責任あるAIをサポートするためには、組織は、人材データとそのガバナンスをAI-readyな形で管理するアプローチを採用する必要があります。企業は、ガバナンス制御をエンタープライズデータプラットフォームに直接組み込むことで、生成AI、アナリティクス、機械学習にわたる一貫性のある強制的な制御を実現し、従業員の信頼を維持しながらAIツールをより大規模に展開するための基盤を構築できます。

人材データがAIガバナンスの最も難しい問題である理由

人材データは、他のエンタープライズデータドメインとは根本的に異なります。プライバシーと倫理的な配慮がなされており、個人に影響を与える影響力の高い意思決定に使用され、重複する規制によって管理され、従業員の信頼に深く結びついています。

AIによって、こうした課題が深刻化します。従来のアナリティクスとは異なり、AIシステムは人材データを単に報告するだけではありません。AIシステムはデータから学習し、推論を行い、それに基づいて行動します。ひとたびAIパイプラインに人材データが入ってくると、その影響力は個々の記録にとどまらず、元のデータにアクセスした後も持続するモデルや予測を形成します。

モダンAIシステムは、生成AIを使用して、離職率の予測、候補者のスコア付け、パフォーマンスと可能性の分析、要約や推奨事項の生成に使用されます。これらのシステムにおいて、ガバナンスの失敗は単なるメトリクスだけでなく、実際の従業員一人ひとりに直接影響を及ぼします。バイアス、誤用、意図しない推論は、発見や覆しがたい形で採用意思決定、キャリアアップ、従業員体験に影響を与える可能性があります。その結果、人材データはAIガバナンスの最も要求度の高い課題の一つとなっています。

人材データに固有のAIリスクカテゴリ

トレーニングデータのリスク

トレーニングデータのリスクは、機密性の高いワークフォースデータや保護されたワークフォースデータがAIモデルトレーニングに組み込まれることで発生します。これにより、本来の用途を超えてモデルの動作に影響を与える可能性があります。モデルは履歴データからパターンを学習するため、トレーニングデータに存在するバイアスや不均衡がモデル自体に組み込まれる可能性があります。

トレーニングデータセットには、デモグラフィック属性、報酬履歴、パフォーマンスフィードバック、健康情報や休暇関連の指標が含まれる場合があります。保護された属性が直接、または相関する特徴量を通じてトレーニングパイプラインに入り込む場合があります。その場合、モデルは過去のバイアスを強化し、差別的な結果を生み出す可能性があります。こうした問題は、展開後に検知するのが難しく、多くの場合、修正には再トレーニングやモデルの廃止が必要となるため、トレーニングデータガバナンスは責任ある人間中心のAIの基盤コンポーネントとなっています。

推論時のリスク

推論時のリスクは、AIシステムがリアルタイムの予測や対話の際に、機密性の高い人材情報にアクセスしたり、それを導き出したりする場合に発生します。推論は連続的で動的なプロンプトによって実行されるため、意図しないデータ露出のリスクが高まります。

人材を中心としたAIソリューションでは、推論に生成AIプロンプト内の従業員コンテキストや、保護された属性の推論が間接的に含まれる場合があります。また、必要以上のデータにアクセスしてしまう可能性もあります。生成AIシステムでは、アクセス時に属性がマスキングされている場合でも、モデルは出力で敏感なコンテキストを表面化することがあります。こうしたリスクは、AIの挙動の予測が困難で大規模に動作する人事チャットボット、マネージャー向けアシスタント、従業員のセルフサービスツールにとって特に顕著です。

運用リスクと信頼リスク

運用リスクと信頼リスクは、AIシステムがガバナンスや監督プロセスが適応できないほど迅速に変化する人材データに依存している場合に発生します。組織構造、職務アーキテクチャ、評価フレームワークは継続的に進化しています。そのため、モデルや特徴量を現在の定義と一致させ続ける必要があります。

強力なガバナンスポリシーがなければ、AIシステムは古いデータや認証されていないデータを消費する可能性があり、特徴量定義がずれ、出力の説明や防御が困難になります。時間の経過とともに、このような失敗は従業員、マネージャー、規制当局の信頼を損なう可能性があります。人材中心のAIシステムに対する信頼が失われると、多くの場合、回復は困難になります。

人材データ向けのAI-readyガバナンスとは

人材データ向けのAI-readyガバナンスは、従業員のプライバシーと組織の信頼を維持しながら、AIライフサイクル全体にわたって人材データの使用を制御、コンテキスト化、トレース、監査することに重点を置いています。これには、データおよびAIアーキテクチャに組み込まれたガバナンスメカニズムが必要です。このメカニズムは、人材データがアクセスまたは使用されるすべての場所でデフォルトで適用される必要があります。

ガバナンスは、事後的に人事アプリケーションや機械学習パイプラインに追加するのではなく、エンタープライズデータプラットフォームに直接組み込む必要があります。これにより、制御と監査機能が本質的に備わったプライバシーバイデザインが実現します。また、明示的に上書きされない限り最も制限の厳しい動作が適用されるプライバシーバイデフォルトも可能になります。

コアとなる要件には、プラットフォームレベルでのデータガバナンス、セマンティックな一貫性を持つメタデータドリブンな分類、プログラムによるポリシーの適用、目的主導型(インテントベース)のアクセス制御、そしてエンドツーエンドのリネージとオブザーバビリティが含まれます。

ガバナンス制御プレーンとしてのデータプラットフォーム

AI-readyガバナンスは、アナリティクス、ML、AIワークロードの制御システムとして機能する一元化されたデータプラットフォームに依存します。そのためには、オープンソースメタデータを含むすべてのデータとAIアセットのガバナンス、発見、共有、展開を支援するエンタープライズデータカタログが必要です。ガバナンス制御は、分離されたツールや下流のプロセスを通じてではなく、データが保存、アクセス、変換される場所で適用されるべきです。

このモデルでは、プラットフォームがワークロード全体での統合アクセス、一元化されたメタデータと分類を提供します。また、マスキングやフィルタリングのための宣言型ポリシー、およびガバナンス制御を継承した共有データアクセスも提供します。

プラットフォームは、データレジデンシー要件も適用する必要があります。従業員データは、管轄区域の制約を受ける場合があります。この制約により、特定の地域からデータを持ち出すことが禁止されることがあります。設計によってデータレジデンシーが適用されると、人材データは物理的にその地域に留まります。一方で、集計、特徴量、モデルパラメータなどのガバナンスが適用された出力は、セキュアなデータ共有やフェデレーテッドラーニングのパターンを使用して共有できます。

コアコンポーネントとしてのセマンティックな一貫性

AIガバナンスにはセマンティックな一貫性が必要です。ガバナンスが適用された人材データモデルは、正規化されたエンティティ、適合ディメンション、イベントおよびスナップショットのファクトを定義します。これにより、一貫したタグ付け、リネージ、スチュワードシップが可能になります。

列レベルの分類は、機密性と許可された使用に基づいて個々の属性にラベルを付けることで、ポリシーを動的に適用できるようにします。承認された人事ロールがアクセスしない限り、PIIをマスキングできます。また、保護された属性をトレーニングから除外したり、推論のために報酬をバケット化したりすることも可能です。これにより、1つのデータセットでガバナンスが適用された多くのユースケースに対応できます。アクセスは、単なるアイデンティティだけでなく、意図に沿ったロールベースのアクセス制御(RBAC)を通じてさらに管理されます。

説明可能性と監査のためのリネージ

リネージは、AIライフサイクル全体で人材データがどのように流れ、変換されるかを可視化します。これには、ソースシステムから特徴量、モデル、AI出力までのプロセスが含まれます。これにより、組織はAIドリブンな意思決定にデータがどのように影響するかを把握できます。

効果的なリネージはプライバシーの保護にも役立ちます。リネージは、匿名の識別子を使用して関係性と影響力を追跡することで、PIIを公開することなく監査と説明可能性をサポートします。特定可能なデータへのアクセスは、個別に管理された目的主導の制御を通じてのみ行われます。このトレーサビリティと識別可能性の分離は、倫理的なAIや、人材データを扱うあらゆるAIソリューションにとって不可欠です。

Snowflake HorizonとAIガバナンスの実施

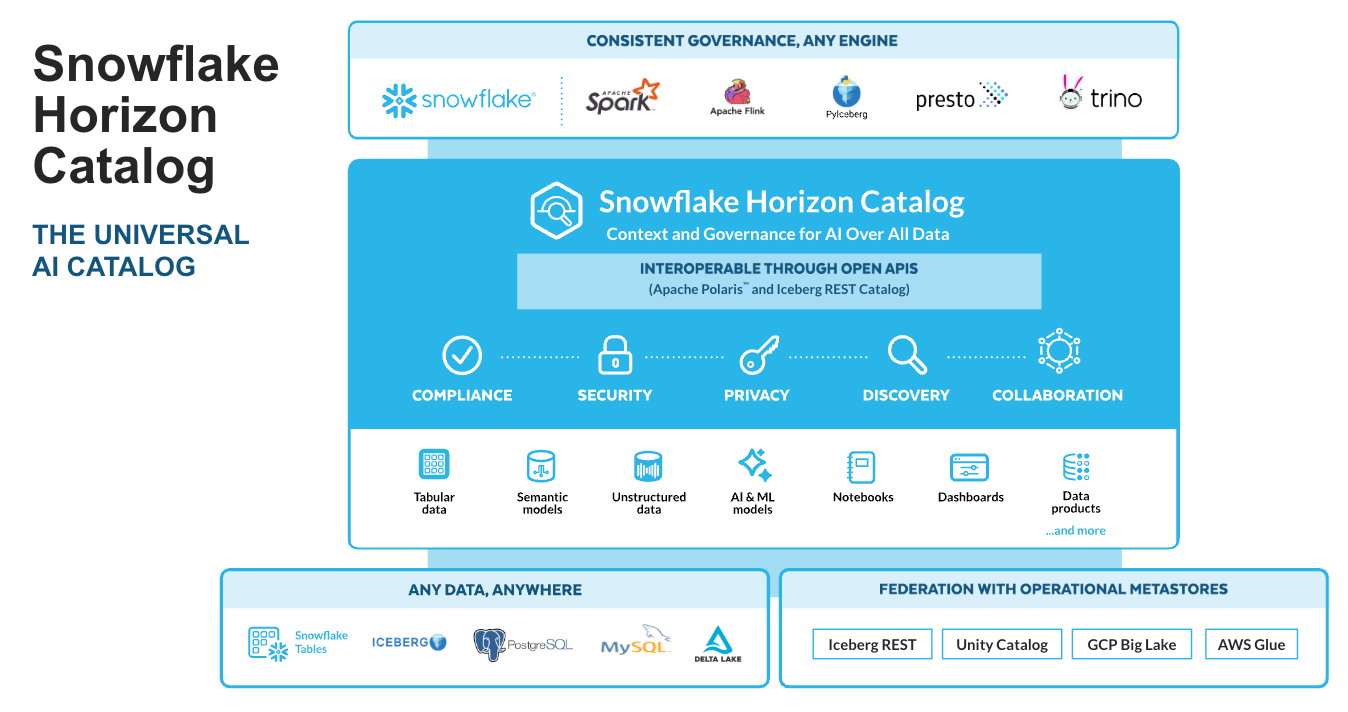

Snowflake Horizonカタログは、すべてのデータにわたるAIのコンテキストとガバナンスを備えたユニバーサルAIカタログです。このカタログは、あらゆる場所のあらゆるエンジンやデータ形式と互換性があります。ネイティブなSnowflakeオブジェクトや、任意のエンジンで読み書き可能なオープンテーブルフォーマット(Apache Iceberg™、Delta)のデータに対応しています。さらに、SQL ServerやPostgresなどのリレーショナルデータベースのデータにも対応します。人材データのAI-readyガバナンスを実現するために必要なコアコンポーネントを提供します。

- ロックインのない相互運用性:異種システムからのデータを統合するレイクハウスアーキテクチャを実現します。Apache IcebergやApache Polaris(インキュベーション中)などのオープン標準を通じて、データの相互運用性とポータビリティを確保します。

- データとAIのためのエンタープライズグレードのセキュリティとガバナンスの機能:データ、AIモデル、AIエージェントにRBACを提供します。

- 関連するコンテキスト:AIがデータをより適切に理解し、解釈できるように支援します。

- クロスリージョン、クロスクラウドの管理性と大規模な共有:一貫した管理、シームレスなコラボレーション、BCDRの実施を可能にします。

Horizonカタログは、アナリティクス、ML、生成AIにまたがる人材データのAI-readyガバナンスを運用できる、統合されたガバナンスレイヤーを提供します。メタデータ主導の分類、アクセスの適用、オブザーバビリティ、リネージを単一のフレームワークに統合します。このフレームワークは、AIライフサイクル全体で一貫して適用されます。また、Snowflake Cortex Guardのような推論時のレイヤーにより、Horizonカタログはガバナンスを単なるポリシー上の概念から、実際に適用可能な運用モデルへと転換します。

AI-readyガバナンス:次のステップ

人材データは、プライバシー、公平性、組織の信頼が交差する位置にあります。AIが従業員に関する意思決定を形成する機会が増えています。そのため、ガバナンスの失敗はビジネスの成果だけでなく、個人にも直接的な影響を与えます。

人材データに対するAI-readyガバナンスには、適用可能な制御をデータプラットフォーム自体に組み込むことが含まれます。これにより、設計およびデフォルトでプライバシー、説明可能性、アカウンタビリティを実現できます。このモデルを採用する組織は、信頼を維持し、規制の期待をサポートし、AIドリブンなアナリティクスの可能性を最大限に引き出しながら、人間中心のAIソリューションを責任をもってスケーリングできます。

Snowflake Horizonカタログの詳細と、Horizonカタログがデータガバナンスのニーズをどのようにサポートしているのかについて詳しくは、開発者ガイドをご覧ください。