複雑さから明確さへ:DebeziumをOpenflowに移行してSnowflakeで活用

最近、私たちはヘルスケア・ライフサイエンス業界の新規のお客様との協力を開始しました。このお客様は、SQL ServerからSnowflakeへのパイプラインのためにDebeziumに多額の投資をしていました。見かけ上は、この選択は理に適っていました。Debeziumは、分散型変更データキャプチャ(CDC)の業界標準です。オープンソースで堅牢であること、そして何より、ライセンス料がかかりません。

しかし、Debeziumの「ゼロ円」という価格設定は、「飲んで終わりの無料ビール」ではなく、「手間のかかる無料の子犬」のようなものでした。初期の節約分は、Kafka Connectクラスターの運用管理という複雑な作業や、スキーマ進化に伴う絶え間ない摩擦によって、あっという間に相殺されてしまったのです。お客様は結局のところ、インフラストラクチャは豊かですが、データは乏しい「現状維持」のために、エンジニアリング時間を費やしていました。

お客様は、専門のエンジニアチームが常にモニタリングやメンテナンスを務める必要のない、ほぼリアルタイムのソリューションを必要としていました。その結果、アーキテクチャ全体をSnowflake Openflowに移行することを決定しました。

その目標は驚くほど、圧倒的にシンプルでした。それは、SQL ServerのデータをSnowflakeへほぼリアルタイムで同期することでした。レイテンシーの時間枠は1~5分であり、これはスピードだけでなく、ミッションにはレジリエンスとスケーラビリティ、そして何より管理しやすいパイプラインが必要でした。

ランドスケープ:スケーラビリティとパフォーマンスの要件

Debeziumのメンテナンスが耐えられなくなった理由を理解するには、移動しているデータ量を調べることが重要です。これは単一テーブルの同期ではなく、お客様のアナリティクスにとって、生命線となる、絶え間ないデータの移動でした。

以下に、プロジェクトの膨大な規模を数字でごく簡単に示します。

- SQL Serverインスタンスの合計数:19

- データベースの合計数:540、19のインスタンスに分散

- テーブルの合計数:各データベースには約240個のテーブルが含まれているため、約129,600個

- レイテンシーの目標:トランザクションがSQL Serverに到達してからSnowflakeでクエリ可能になるまで、1~5分間の厳格な時間枠

この規模では、旧設計にわずかな不具合が生じただけでも、大規模なバックログが発生していました。従来の方法では、30分間の停止に追いつくには、何時間もの手作業が必要でした。お客様は、常時モニタリングすることなくこのボリュームを扱えるシステムを必要としていました。

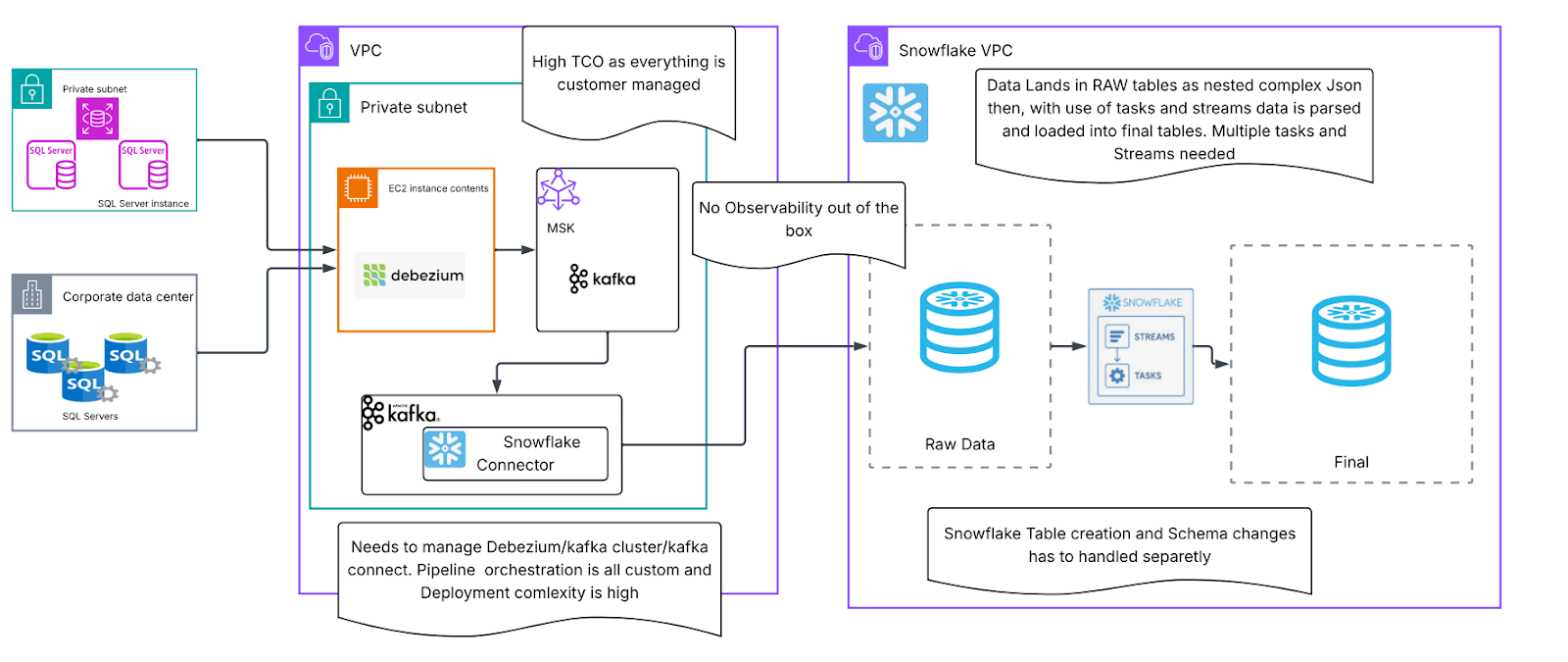

レガシーの負担:マルチホップのDebeziumアーキテクチャ

レガシーアーキテクチャ:まるで7層ケーキのように積み重なった複雑さ

移行前のデータは、ソースから最終的なアナリストダッシュボードまで、長い複雑な過程をたどっていました。ワークフローは次のようになっていました。

- トリガー:DebeziumをSQL Server CDCのログにフックして、行レベルの変更を検出します。

- 仲介機能:これらのイベントはシリアライズされ、特定のKafkaトピックにプッシュされます。

- ブリッジ:これらのトピックをポーリングしてSnowflakeのステージング領域にデータをプッシュするには、Kafka Connectクラスターが別途必要でした。

- 未加工領域:データは「生JSON」の塊としてSnowflakeに届き、本質的にはメタデータとネストされたペイロードが乱雑になっていました。

- クリーンアップ:Debeziumのイベントは(変更前後の状態を含む)複雑なエンベロープに包まれているため、カスタムのSnowflakeタスクを自分たちで書き、メンテナンスし続けなければなりませんでした。

- フラット化:これらのタスクは定期的にトリガーされ、JSONを解析してデータをリレーショナルフォーマットにフラット化します。

- 最終的な結合:このような過程を経て、やっとデータを最終的な実稼働テーブルに結合して利用できるようになります。

なぜこれが「運用オーバーヘッド」だったのか

図 1の各矢印は、潜在的な障害点を表しています。Kafka Connectの作業に遅延が発生すると、データに遅れが生じていました。Snowflakeタスクが失敗した場合、生テーブルは解析されていないデータで膨れ上がっていました。単にデータを移動するだけでなく、相互依存するサービスの複雑なエコシステムも管理することになっていたのです。

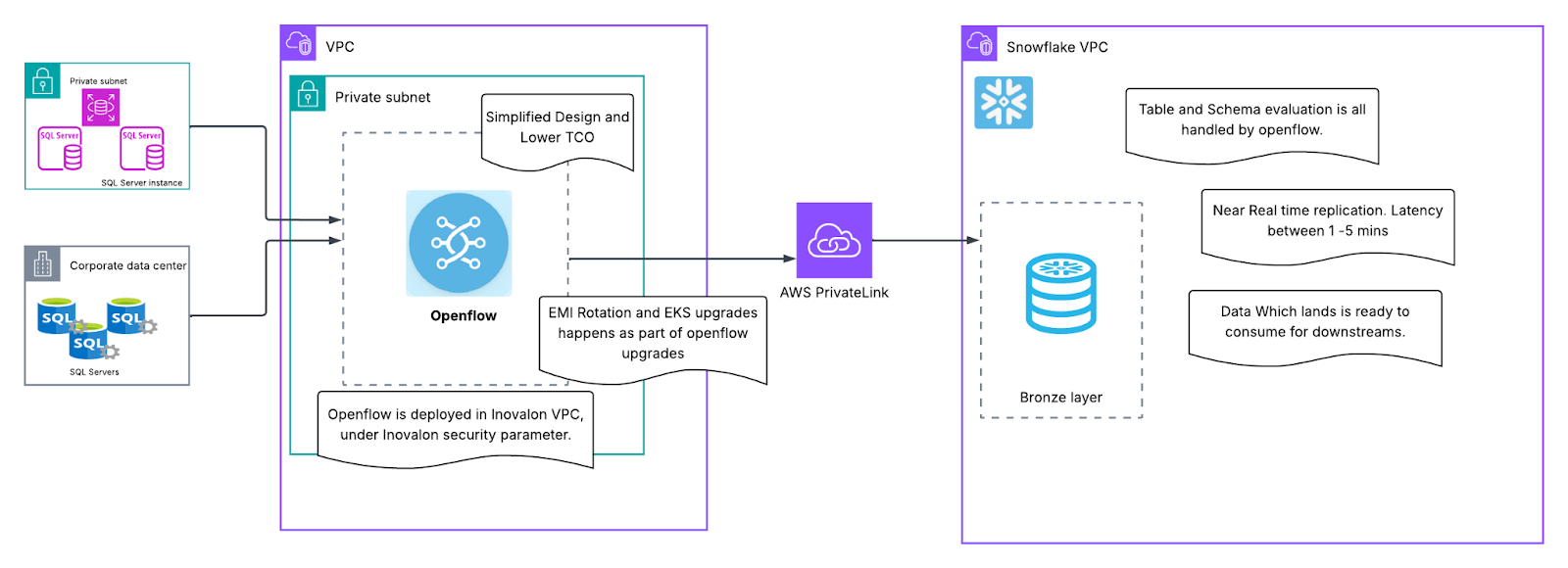

スタックの再構築:Openflowの直接取り込みモデル

Openflowの進化:スタックの再構築

図 1が運用オーバーヘッドを示すとすれば、図 2は直行便のようなシンプルな構成を示しています。Openflowを導入したことで、アーキテクチャ上の「ノイズ」が解消されました。Debezium、MSK、Kafka Connect、Snowflakeの手動タスクによるマルチホップリレーではなく、SQL ServerからSnowflakeへの直接のアプローチに移行しました。

Openflowによるパイプラインの再定義:

- 変更追跡の有効化:CDCの代わりに、Openflow SQL Serverコネクタはネイティブの変更追跡を利用して、極めて高い精度でトランザクションを特定します。

- スキーマ進化の自動化:Debeziumの最大の頭痛の種の一つであったスキーマのずれが解決しました。Openflowはソースの変更を自動的に検出し、Snowflakeテーブルをリアルタイムで更新します。データベース管理者(DBA)が列を追加しても、パイプラインが中断することがなくなりました。

- Snowflakeへの直接取り込み:このようにして、Kafkaの使用を完全に回避しました。OpenflowはSnowflakeへの取り込みを直接処理するため、仲介ストレージや外部コンピュートクラスターは不要です。

- カスタムタスクの排除:Openflowはデータをすぐに使用できる形式で提供しているため、お客様はSnowflakeの複雑なフラット化タスクのライブラリを削除し、結合スクリプトも削除することができました。

比較

DebeziumとOpenflowを、お客様の実稼働セットアップでの実際の運用メトリクスで比較してみましょう。

| 比較要素 | Debezium | Openflow |

|---|---|---|

| CDCメカニズム | CDC(重度) | 変更追跡(軽度) |

| SQL Serverのオーバーヘッド | 高い | 低い |

| パイプラインオーケストレーション | カスタム/手動 | Snowflakeマネージド |

| 展開の複雑さ | 非常に高い | 低~中程度 |

| スキーマメタデータ | Kafkaメッセージに埋め込まれたスキーマメタデータで構造的なCDCイベントを生成する | Snowflake内でスキーマメタデータを自動的に管理 |

| Snowflakeでのテーブル作成 | 手動で処理 | コネクタによる自動管理 |

| スキーマの進化 | スキーマの変更を手動で検出して適用する必要がある | コネクタによる自動管理 |

| データフロー | SQL Server -> Kafkaトピック -> Kafka Connect -> 未加工テーブル -> カスタム結合タスク -> 最終テーブル | SQL Server -> Snowflake最終テーブル |

| 結合と変換 | JSONのフラット化とCDC行の結合に必要なSnowflakeのカスタムタスク | コネクタによる自動管理 |

| 責任境界 | DebeziumはKafkaへのイベントのみを処理するため、ダウンストリーム処理の構築とメンテナンスが必要 | Openflowが処理するエンドツーエンドのパイプライン |

| オブザーバビリティ | カスタム | すぐに使用可能 |

ここでは、DebeziumとOpenflowの実際のコスト比較を示しています。

| 比較要素 | Debezium | Openflow |

|---|---|---|

| ライセンスコスト | オープンソース、コネクタのライセンス料なし | Openflowの個別のプロダクトライセンスは不要 |

| インフラストラクチャのコスト | Kafkaエコシステムが必要:MSK/Kafkaブローカー + Kafka Connectの作業員 | お客様のVPCにOpenflow BYOCを展開する必要があるが、クラウドのフォーメーションにより自動化される。 |

| 運用コスト | Kafkaのスケーリング、メンテナンス、モニタリングによって非常に高い。別途、L2サポートチームが管理する必要あり。 | 比較的低い。Openflow BYOCの展開は、Snowflakeとお客様が共同で責任を負い、Snowflakeはすべてのステップを自動化する。 |

| Snowflakeの費用 | ストレージ、ウェアハウス、Snowpipe/Snowflakeシンクコネクタ | ストレージ、ウェアハウス、Snowpipe Streaming、Openflowコンピュート |

結論:簡素化のタイミングを判断するポイント

DebeziumからOpenflowへの移行は、単にツールを変更するだけではありません。エンジニアリングの時間を解放します。Kafkaという「仲介役」を排除したことで、お客様はインフラストラクチャのコストを節減できただけでなく、常時モニタリングすることなく拡張できるレジリエンスの高い自己修復パイプラインを獲得しました。

現在、「インフラストラクチャが豊富でデータに乏しい」状態になっている場合は、スタックをシンプルに再構築する時期かもしれません。

Snowflakeの取り込みを簡素化する準備はできていますか?

ステップを進める方法は、次のとおりです。

- オーバーヘッドの監査:現在のDebezium/Kafkaのメンテナンス時間を確認してください。週に2時間以上をインフラストラクチャの保守作業に費やしているのであれば、Snowflake Openflowの最適な候補と言えます。

- 手順の紹介:Snowflakeのドキュメントで、OpenflowがSQL Serverの変更追跡をネイティブに処理し、Snowflakeスキーマの進化を自動化する様子をご覧ください。

- パイロットの開始:概念実証(PoC)を設定し、Openflowの1~5分間のレイテンシーの安定性を現在のDebeziumセットアップと比較します。